Clear Sky Science · ar

GWKNN: خوارزمية k-الجيران الأقرب المحسّنة بإعادة بناء مقياس G ومحسّن الذئاب الرمادية

تمييز أنماط أذكى في ظل فيض البيانات الحالي

من الصور الطبية إلى معاملات البنوك، تولّد الحياة المعاصرة محيطات من البيانات. يجب تصنيف كثير من هذه المعلومات تلقائياً إلى فئات: سليم أم مريض، مُحتال أم طبيعي، بريد مزعج أم حقيقي. أحد الأعمدة الكلاسيكية لهذه المهام هو خوارزمية k-أقرب الجيران (KNN)، التي تُعَيّن تسمية للحالة الجديدة من خلال النظر إلى أمثلة سابقة الأكثر تشابهاً. لكن مع اتساع قواعد البيانات وتعقّدها وازدياد عدم توازن الفئات، يبدأ هذا المبدأ البسيط في الاختلال. تُقدّم الورقة GWKNN، نسخة مُجدَّدة من KNN صممت لاستغلال المسافات بين النقاط بذكاء أكبر ولمعالجة الحالات النادرة لكن المهمة بعدالة أكبر.

لماذا تفشل البساطة التقليدية أحياناً

تفترض KNN التقليدية أن كل ميزات نقطة البيانات تساهم بالتساوي وتقيس التشابه بمسافة خطية قياسية. قد ينجح ذلك عندما تكون البيانات منخفضة البُعد ومفصولة بوضوح، لكن بيانات العالم الحقيقي غالباً ما تكون عالية البُعد، صاخبة، ومزيجاً من أنواع معلومات مختلفة. في هذه الحالات قد تكون المسافة الاعتيادية مضللة، ما يدفع الخوارزمية لاختيار جيران غير مفيدين. وفي الوقت نفسه، كثير من مجموعات البيانات غير متوازنة: تهيمن الفئات الشائعة بينما تكون الفئات النادرة ولكن الحرِجَة، مثل مرض في مراحله المبكرة، ممثلة تمثيلاً ضئيلاً. عندما يصوت KNN بين الأمثلة القريبة، تميل الفئة الأغلبية إلى طمس هذه الحالات الأقلية، ما يقود إلى قرارات متحيزة وأحياناً خطرة.

تعليم الخوارزمية إحساساً أفضل بالمسافة

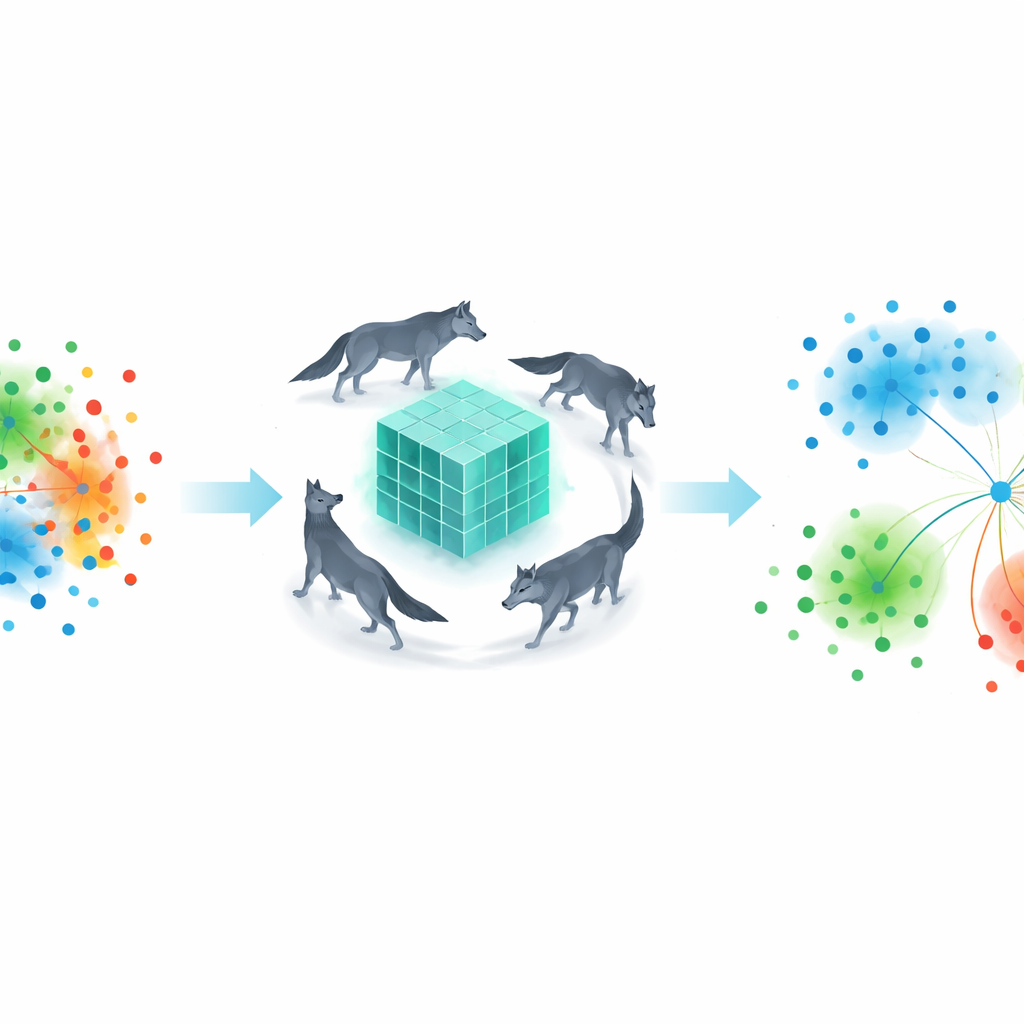

الابتكار الرئيسي الأول في GWKNN هو مقياس مسافة متعلَّم. بدلاً من الالتزام بالقاعدة الخطية الاعتيادية، يتيح المؤلفون للخوارزمية اكتشاف كيف ينبغي أن تكون المسافات بين نقاط البيانات بطريقة تفصل الفئات بأفضل شكل. يُرمَز لذلك بمقياس «G» المرن الذي يعيد تشكيل الفضاء بحيث تُؤخذ الميزات الغنية بالمعلومات بعين الاعتبار أكثر وتُخفَّف أهمية الميزات المتكررة أو غير المفيدة. لضبط هذا المقياس، تستعير الطريقة إلهامها من سلوك الصيد لدى الذئاب الرمادية. إجراء ذكاء السرب المسمى محسّن الذئاب الرمادية يستكشف العديد من الطرق الممكنة لتمديد وضغط فضاء البيانات، محتفظاً بتلك التي تقلل أخطاء التصنيف مع الحفاظ على الاستقرار الرياضي. عبر تكرارات متعددة، تتقارب «الذئاب» الافتراضية على قاعدة مسافة تجعل النقاط المتشابهة تتجمع معاً بثبات أكبر، حتى في مجموعات البيانات عالية البُعد والمعقدة.

منح الحالات النادرة صوتاً أقوى

التحسين الثاني يستهدف انحياز التصويت. KNN القياسية ببساطة تحصي عدد الجيران k المنتمين إلى كل فئة وتختار الأغلبية. بدلاً من ذلك، تُقَيّم GWKNN كل صوت وفقاً لمدى شيوع تلك الفئة في بيانات التدريب العامة. تُمنح الفئات الأقل تكراراً أوزاناً أقوى؛ أما الفئات المتكررة جداً فتحصل على أوزان أضعف. يمنع مصطلح تنعيم صغير الفئات شديدة الندرة من أن تطغى كلياً على القرار. هكذا، إذا كانت نقطة جديدة قريبة من عدد قليل من أمثلة الفئة الأقلية والعديد من أمثلة الفئة الأغلبية، لا تُطمَس إشارات الأقليّة تلقائياً. المخطط بسيط حسابياً لكنه ذو أثر قوي: يدفع المصنّف لإيلاء اهتمام أكبر للأنماط النادرة لكنها ذات دلالة، محققاً عدالة واستدعاء أفضل للفئات الأقليّة.

اختبار الطريقة الجديدة

لفحص ما إذا كانت GWKNN مفيدة عملياً، قيّمها المؤلفون على 12 مجموعة معيارية من مستودع UCI المعروف. تغطي هذه المجموعات بيانات مالية، قياسات طبية، خطوط كتابة اليد، بذور نباتية، والعديد من مجموعات بيانات سرطان وتعبير جيني عالية البُعد، مع مشكلات ثنائية ومتعددة الفئات. قارنوا أربع نسخ من KNN: الخط الأساسي البسيط، نسخة تحتوي على مقياس المسافة الجديد فقط، نسخة تحوي أوزان التصويت الجديدة فقط، وGWKNN الكامل الذي يجمع الفكرتين. كما واجهوا GWKNN مع سبعة مصنِّفات مستخدمة على نطاق واسع، بما في ذلك آلات الدعم الناقل، أشجار القرار، الغابات العشوائية، الانحدار اللوجستي، نايف بايز، وشبكة عصبية. عبر تقسيمات تدريب–اختبار متكررة، تابعوا ليس فقط الدقة المتوسطة بل أيضاً مدى تقلب النتائج.

النتائج: أكثر دقة وأكثر اتساقاً

خرج نهج GWKNN المجمّع في الصدارة أو متعادلاً مع الأفضل في معظم مجموعات البيانات، خصوصاً تلك التي تحتوي على العديد من الميزات وأحجام فئات غير متكافئة. في المهام البسيطة نسبياً، أدت كل الطرق بشكل جيد وكانت المكاسب متواضعة، لكن GWKNN ظل يميل إلى تحسين الدقة وتقليل التباين قليلاً. في مجموعات بيانات تعبير جيني الأصعب ذات الآلاف من الميزات، كانت المزايا أوضح: ساعد مقياس المسافة المتعلَّم الخوارزمية على تكوين جيران أكثر دلالة، وحسّن تصويت الأوزان التعرف على الفئات الممثلة تمثيلاً ناقصاً. اختبارات إحصائية عبر كل المجموعات أكدت أن ترتيب GWKNN كان أفضل بشكل معنوي مقارنةً بـKNN القياسي وبعض النماذج الكلاسيكية، مشيرة إلى أن تحسيناته ليست مجرد تقلبات محظوظة بل متينة عبر ظروف بيانات مختلفة.

ماذا يعني ذلك لقرارات البيانات اليومية

بالنسبة لغير المتخصصين، الخلاصة أن GWKNN يصقل فكرة بديهية للغاية—«انظر إلى الحالات المماثلة الماضية»—لتتناسب بشكل أفضل مع واقع البيانات الحديثة الفوضوي. عبر تعلم كيفية قياس التشابه بطريقة مستندة إلى البيانات وتعزيز تأثير الفئات النادرة أثناء التصويت، تهدف الطريقة لأن تكون أكثر دقة وأكثر عدلاً. ومع أن هذه التعقيدات الإضافية تأتي بتكلفة حسابية أكبر، خصوصاً للمجموعات الضخمة وعالية البُعد، تظهر GWKNN وعداً قوياً لمهام يكون فيها التصنيف الصحيح للحالات الأقليّة مهماً حقاً، مثل اكتشاف الأمراض المبكرة أو كشف الاحتيال. يوضح العمل كيف يمكن ترقية الخوارزميات الكلاسيكية برؤى من التحسين والعدالة لمواكبة حجم وتعقيد معلومات اليوم.

الاستشهاد: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

الكلمات المفتاحية: k-أقرب الجيران, تعلم مقياس المسافة, عدم توازن الفئات, ذكاء السرب, تصنيف البيانات