Clear Sky Science · ar

إطار متكامل للتصدي الاستباقي للتزييف العميق عبر وسم مدفوع بالانتباه وتحقق من الأصالة قائم على البلوكتشين

لماذا تشكل الفيديوهات المزيفة مشكلة للجميع

بات من الممكن الآن تزوير فيديوهات تبدو وتسمع كالحقيقية باستخدام برامج جاهزة، ما يطمس الحدود بين الحقيقة والخيال على الإنترنت. تُستخدم هذه التزييفات العميقة بالفعل في الاحتيال والمضايقات والمناورات السياسية. بدلاً من محاولة رصد المزيفات بعد انتشارها، تطرح هذه الدراسة سؤالاً مختلفاً: ماذا لو استطعنا حماية الفيديوهات الأصلية بهدوء في لحظة إنشائها، بحيث يصبح أي تلاعب لاحق واضحاً؟

من مطاردة المزيفات إلى حماية الأصول

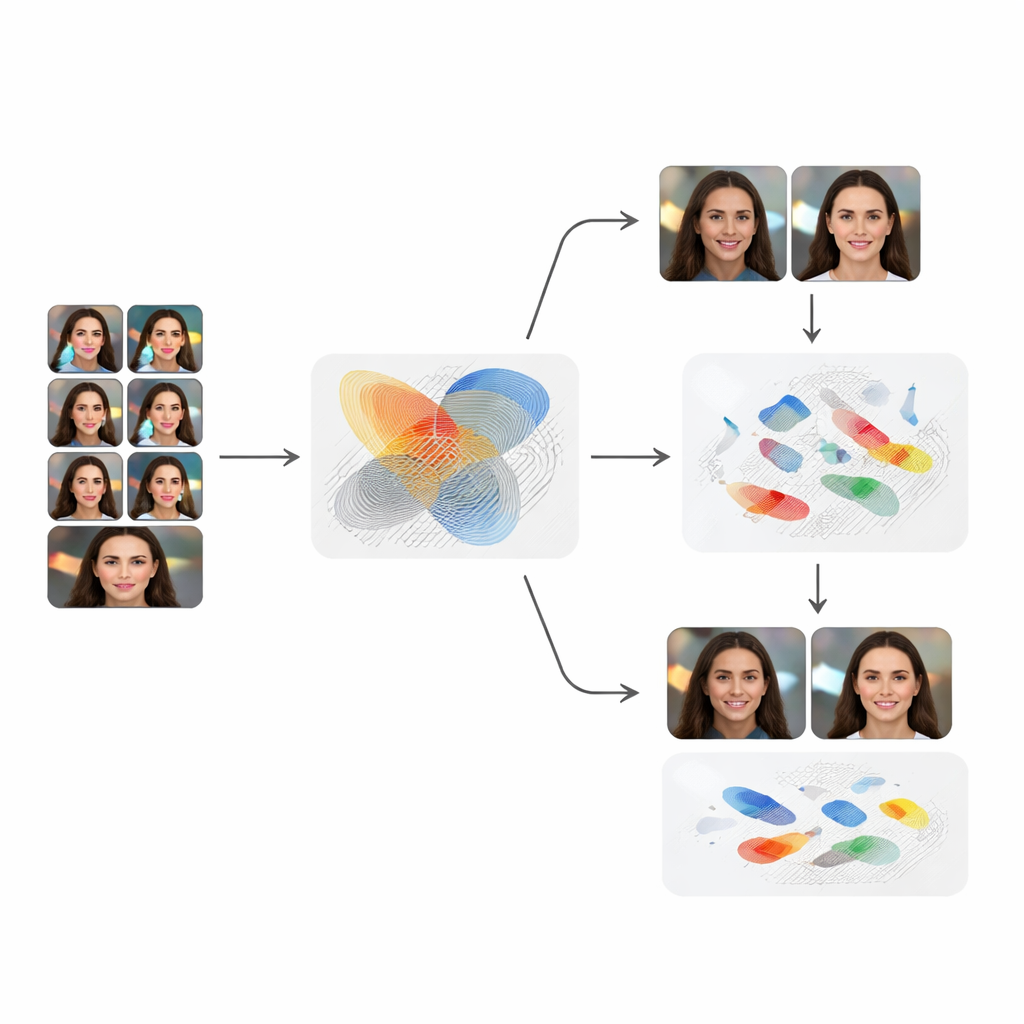

تسعى معظم الأبحاث الحالية إلى كشف التزييفات بعد وقوعها، عبر تدريب خوارزميات لالتقاط عيوب صغيرة يتركها نماذج التوليد. ومع تحسن تلك النماذج يصبح هذا التنافس أكثر صعوبة. ويؤيد المؤلفون منهجاً استباقياً: حماية اللقطات الأصلية أثناء تسجيلها، بحيث يمكن للمشاهدين والمنصات التحقق لاحقاً مما إذا كان ما يرونه هو النسخة غير المُعدّلة. يجمع إطارهم بين ثلاث طبقات: محلل فيديو ذكي يقرر أين تكمُن أهمية الحماية، ووسم رقمي غير مرئي يندمج في كل إطار، وسجل بلوكتشين يُقفل هوية الملف ككل.

تعليم النظام ما له قيمة حقيقية في الفيديو

الطبقة الأولى هي نموذج انتباه يتعلم أي أجزاء الفيديو تحتوي على أكثر الحركة والتفاصيل المعنوية مع مرور الزمن. درّب الفريق شبكة مدمجة لكنها فعالة على آلاف المقاطع اليومية التي تظهر أشخاصاً يقومون بأفعال. يفحص جزء من الشبكة كل إطار كصورة ثابتة، بينما ينظر جزء آخر إلى كيفية الحركة عبر مقاطع مؤلفة من 16 إطاراً. معاً يحققان دقة تزيد عن 97% في اختبار قياسي للتعرّف على الأفعال، ما يدل على أن النظام تعلم أنماطاً غنية لتغير البشر والمشاهد عبر الزمن. تُحوّل هذه الأنماط بعد ذلك إلى خرائط انتباه تُبرز المناطق التي سيؤثر أي تلاعب فيها بشدة على القصة التي يرويها الفيديو.

إخفاء علامة سرية حيث سيُحدث المزوّرون أكبر ضرر

بعد ذلك، يُدمَج وسم رقمي غير مرئي—علامة مائية—في كل إطار، لكن ليس بطريقة بسيطة ومتماثلة. تنشئ شبكة توليد نمطاً دقيقاً يشبه الضجيج يُمزج بقوة أكبر في المناطق التي يحددها نموذج الانتباه كمهمة، مثل الوجوه أو الأيدي المتحركة، وبشكل أضعف في أماكن أخرى للحفاظ على جودة المشهد. لا يلاحظ المشاهدون فرقاً، وتؤكد درجات الجودة أن الإطارات المعلّمة تكاد تكون غير قابلة للتمييز عن الأصلية. ومع ذلك يكون النمط قوياً ومعقّداً بما يكفي لأن تستعيده شبكة مرافقية مدرّبة كفكّاك لاحقاً من اللقطات الأصلية، إطاراً بإطار.

تعريض التزييفات والتشويهات اليومية للاختبار

لاختبار مدى متانة هذه الحماية في العالم الواقعي، أجرى المؤلفون سلسلة اختبارات ضغط. قاموا أولاً بوسم مجموعة متنوعة من مقاطع الفيديو القصيرة ثم أدخلوها في DeepFaceLab، أحد أشهر أدوات تبديل الوجوه، لإنشاء تزييفات عميقة مقنعة. في كل واحد من 50 مقطعاً مُعدّلاً، تُدمَر العلامة المخفية أو تتشوّه بشدة، ويصنّف النظام الفيديو على أنه تم التلاعب به بشكل صحيح. كما تصمد الطريقة جيداً أمام خطوات المعالجة الشائعة مثل إعادة الضغط القوية وتغيير الحجم والتغبيش التي تحدث غالباً عند مشاركة المقاطع على الإنترنت، رغم أن الضجيج العشوائي القوي جداً قد يغلب الإشارة المخفية في النهاية. تُظهر تجارب دقيقة أن كل من إرشاد الانتباه واستخدام الحركة عبر الزمن ضروريان؛ فإزالة أيٍّ منهما تُضعف الحماية بشكل ملحوظ.

تثبيت الثقة ببصمة دائمة

تتجاوز الطبقة النهائية محتوى الإطارات وتؤمن ملف الفيديو نفسه. بعد الوسم، يُشغّل الملف الكامل عبر دالة تشفيرية تنتج بصمة رقمية قصيرة. تُكتب تلك البصمة، مع معلومات أساسية عن المقطع، في سجل بلوكتشين لا يمكن تعديله دون ترك أثر. لاحقاً، يمكن لأي شخص رفع نسخة من الفيديو: يحاول النظام استعادة الوسم ويعيد أيضاً حساب البصمة التشفيرية. إذا تطابقت كل من العلامة المخفية والبصمة التشفيرية مع السجلات الأصلية، يمكن اعتبار الفيديو أصلياً بثقة عالية؛ وإذا فشل أي منهما فسيعرف المشاهدون أن اللقطات قد تغيّرت.

ماذا يعني هذا بالنسبة للفيديوهات التي تشاهدها

بعبارة بسيطة، تُظهر هذه الأعمال أنه بإمكاننا الانتقال من التخمين حول ما إذا كان الفيديو مزيفاً إلى إثبات أن الفيديو حقيقي. عن طريق نسج علامة ذكية يصعب تزويرها في أهم أجزاء كل إطار ودعمها بإدخال لا يمكن التلاعب به في سجل، يلتقط الإطار جميع هجمات تبديل الوجوه المختبرة ويصمد أمام العديد من التشويهات اليومية. ورغم أنه ما يزال يواجه صعوبات أمام الضجيج البصري الشديد ويحتاج إلى اختبارات أوسع، فإنه يشير إلى مستقبل يمكن للكameras والمنصات وغرف الأخبار أن تُصدر فيه فيديوهات مع دليل أصالة مضمّن—مما يجعل من الصعب جداً على التزييفات العميقة أن تمرّ كحقيقة.

الاستشهاد: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

الكلمات المفتاحية: حماية من التزييف العميق, أصالة الفيديو, الوسم الرقمي, التحقق عبر البلوكتشين, أمن الوسائط