Clear Sky Science · ar

إطار مرن لتحسين معلمات الضبط باستخدام الهوموتوبي والنماذج البديلة

لماذا يهم ضبط مؤشرات الذكاء الاصطناعي

تعتمد أنظمة الذكاء الاصطناعي الحديثة ليس فقط على خوارزميات ذكية وكم هائل من البيانات، بل أيضاً على طبقة حساسة من الإعدادات تُسمى «معلمات الضبط» أو الـ hyperparameters. هذه هي المؤشرات التي تحدد حجم النموذج، سرعة تعلمه، وكيفية تعامله مع الضوضاء في البيانات. اختيارها بشكل خاطئ قد يحوّل نظاماً واعداً إلى فشل. تعرض هذه الورقة HomOpt، طريقة جديدة لضبط هذه المؤشرات بكفاءة وموثوقية أكبر، خصوصاً عندما يكون فضاء البحث هائلاً ومعقّداً، ما يجعلها جذابة لأي شخص يسعى لجعل الذكاء الاصطناعي يعمل بشكل أفضل مع قدر أقل من المحاولات العشوائية.

طريقة جديدة لتوجيه البحث

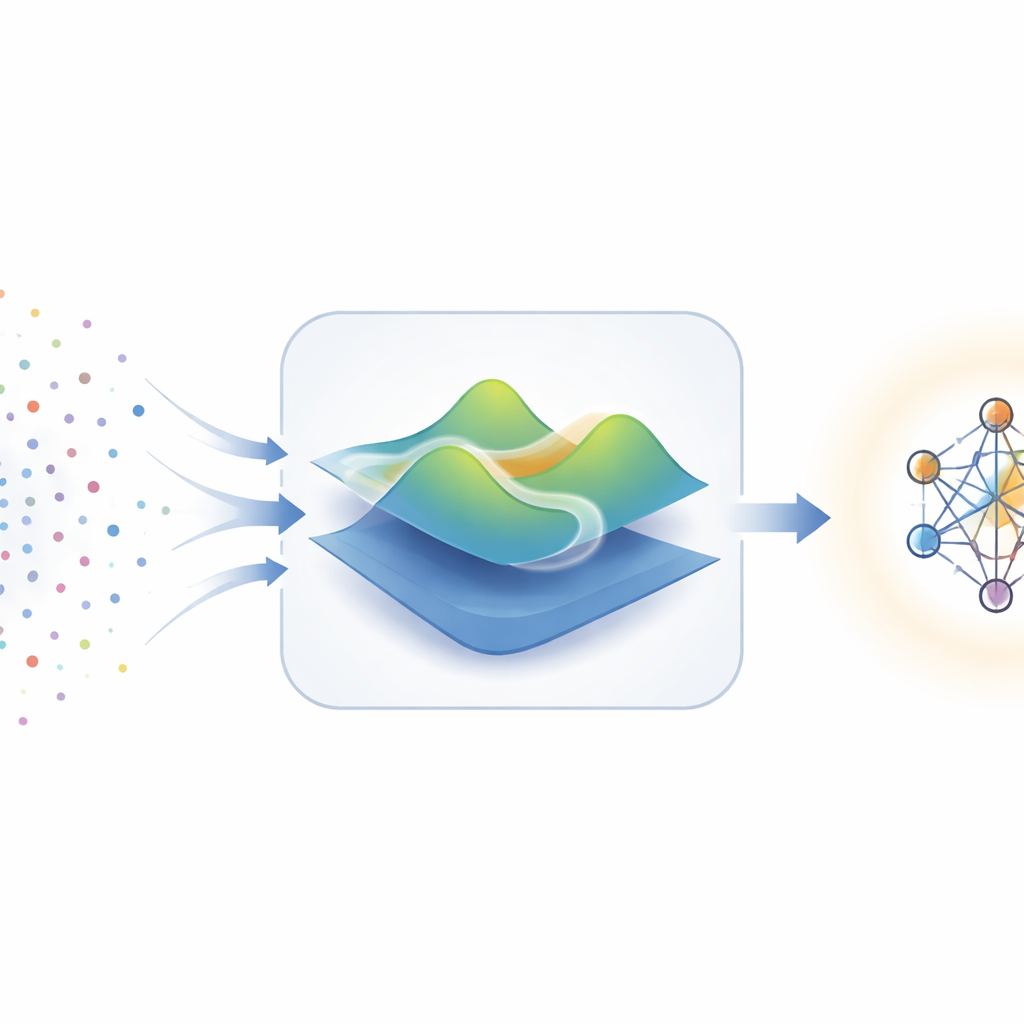

التقنيات التقليدية لضبط معلمات الضبط، مثل البحث الشبكي أو البحث العشوائي، تشبه إلى حد ما تجربة وصفات عبر خلط مكوّنات عشوائياً على أمل أن ينتج طعمٌ جيد. تحاول الأساليب الأكثر تطوراً، كتحسين بايزي، أن تكون أكثر فهماً من خلال بناء نموذج تقريبي لكيف تؤثر الإعدادات على الأداء، ثم استخدام ذلك النموذج لاختيار التركيبة التالية للتجربة. لكن هذه الطرق تفترض أن «منظر» الأداء أملس وحسن التصرف، وهو ما لا يكون صحيحاً غالباً في المشكلات الواقعية المليئة بالخصائص الغريبة، والضوضاء، والقفزات المفاجئة. تتعامل HomOpt مع هذا التحدي عبر بناء نماذج بديلة تقريبية للمنظر الحقيقي بشكل متكرر—تُسمى نماذج بديلة—ثم تحويل كل نموذج بديل بسلاسة إلى التالي مع توافُر مزيد من البيانات، مع تتبُّع كيفية تحرك الحل الأفضل خلال هذا التحول.

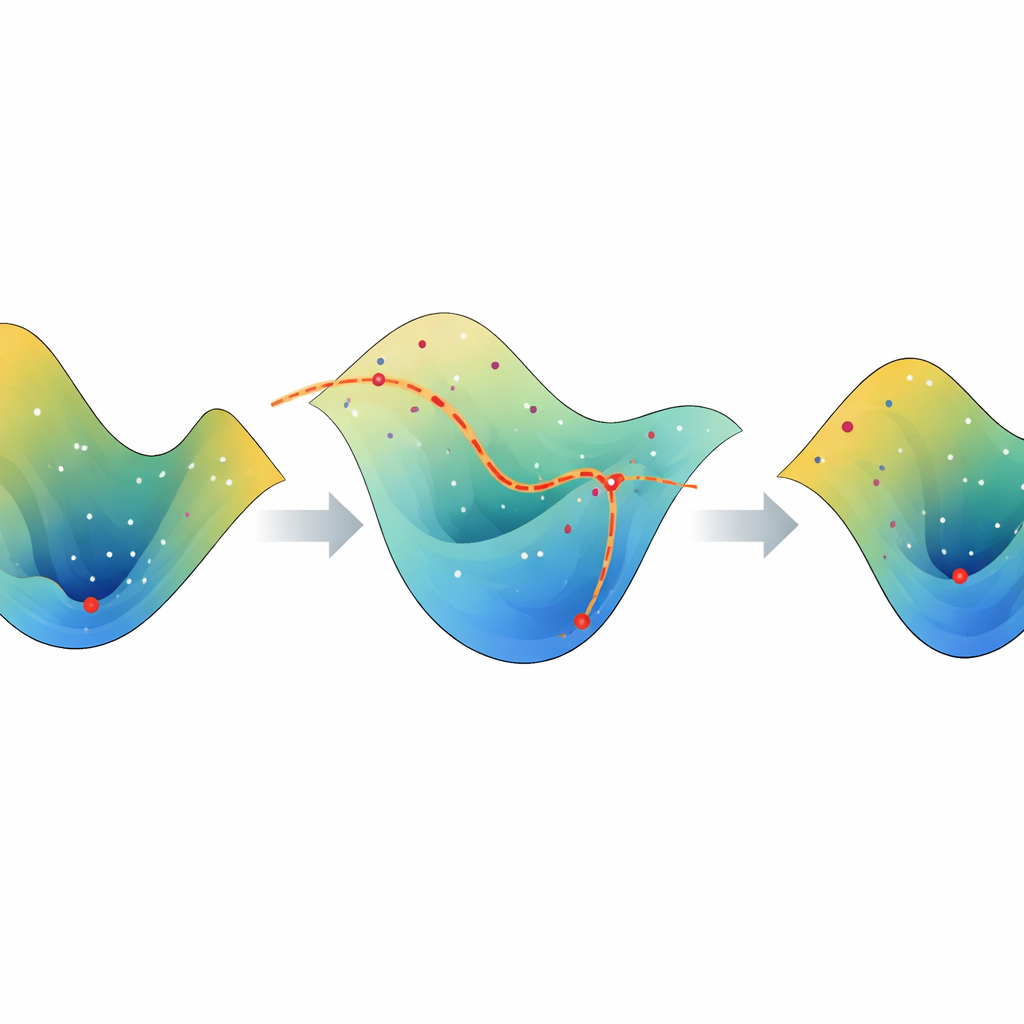

تحويل النماذج بسلاسة بدلاً من البدء من الصفر

الفكرة الأساسية في HomOpt مستمدة من مفهوم رياضي يُسمى الهوموتوبي، والذي ببساطة يعني تحويل شكل تدريجي إلى آخر دون تمزيق أو قفزات. في هذا الإطار، يكون كل نموذج بديل صورة مُمَيَّرة لكيف تؤثر إعدادات معلمات الضبط المختلفة على أداء النموذج. مع جمع نتائج تجريبية جديدة، يُنشئ HomOpt نموذجاً بديلاً محدثاً ثم يحدد تحويلاً مستمراً بين النسخة القديمة والنسخة الجديدة. بدلاً من تجاهل العمل السابق وإعادة بدء البحث، يتعقب كيف ينزلق أفضل نقطة على السطح القديم عبر هذا المشهد المتغير لتستقر عند نقطة جيدة على السطح الجديد. هذا التحرك الموجَّه يجعل البحث أكثر توجهاً وأقل عشوائية، مما يزيد فرص العثور على إعدادات أفضل في خطوات أقل.

أدوات مرنة لأنواع بيانات مختلفة

لإثبات فعالية الفكرة عملياً، يوصّل المؤلفون نوعين مختلفين للغاية من النماذج البديلة إلى HomOpt. أولاً، يستخدمون النماذج الإضافية المعممة (Generalized Additive Models)، وهي ناعمة وسهلة التفسير نسبياً، ما يجعلها مفيدة عندما تتغير العلاقات بين الإعدادات والأداء بشكل تدريجي. ثانياً، يستخدمون CatBoost، وهو طريقة تجميع قوية مناسبة للمشكلات المعقدة عالية البُعد مثل تعرف الصور. لا تقيد HomOpt نفسها بنموذج بديل واحد؛ بل تعامل اختيار النموذج كعنصر قابِل للتركيب يمكن أن يتلاءم مع صعوبة وبنية المهمة. يستطيع الإطار التعامل مع إعدادات مستمرة، متقطعة وفئوية، ويمكن أن يعمل فوق استراتيجيات بحث شائعة مثل البحث العشوائي، التحسين البايزي، أو طرق شجرية، ليعمل كطبقة تحسين إضافية بدل أن يكون بديلاً تاماً.

اختبار الطريقة

يقيم الباحثون HomOpt على مجموعة متنوعة من المقاييس المعيارية. في مهام تعلم آلي كلاسيكية مأخوذة من مجموعات بيانات جدولیة عامة، يقومون بضبط نماذج مثل آلات الدعم الناقلة، الغابات العشوائية، الانحدار اللوجستي، الشبكات متعددة الطبقات، والشجر المعزز بالتدرج. كما يفحصون مشكلات تعرف بنطاق مفتوح تتطلب من النظام التعامل مع فئات لم تُرَ سابقاً، باستخدام مصنف متخصص يُسمى آلة القيمة القصوى (Extreme Value Machine). أخيراً، يختبرون HomOpt على جداول بحث بنى الشبكات العصبية لمجموعات صور معروفة مثل CIFAR-10 ومجموعات على غرار ImageNet، حيث يكون فضاء التصميمات المحتملة واسعاً ومتعرجاً بشكل خاص. عبر العديد من هذه الإعدادات، يسرّع HomOpt عادةً النزول نحو حلول جيدة أو يحسّن الأداء النهائي بالمقارنة مع الطرق الأساسية وحدها، وغالباً باستخدام عدد أقل من تقييمات النماذج المكلفة.

ماذا يعني هذا لممارسات الذكاء الاصطناعي اليومية

بالنسبة للممارسين، الرسالة الأساسية أن HomOpt يوفر طريقة منظمة لجعل ضبط معلمات الضبط أكثر ذكاءً بدلاً من جعله أكثر شمولية فقط. من خلال تنقيح صورة تقريبية لمنظر الأداء بشكل مستمر واتباع كيف تتحرك أفضل نقطة أثناء تحسُّن تلك الصورة، تقلل الطريقة من البحث الضائع وتستفيد أفضل استفادة من كل تشغيل للنموذج. وبما أنها تعمل مع مجموعة واسعة من مقاييس الخسارة وأنواع النماذج واستراتيجيات البحث، يمكن اعتبار HomOpt ملحقاً عاماً لأدوات التحسين الموجودة. ببساطة، تعد الطريقة بأن تُخرج أنظمة ذكاء اصطناعي أكثر دقة ومتانة من نفس ميزانية الحساب—وبطريقة قابلة للتدرج من المشكلات الجدولية الصغيرة إلى المهام البصرية الكبيرة والمعقّدة.

الاستشهاد: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

الكلمات المفتاحية: تحسين معلمات الضبط, النماذج البديلة, طرق الهوموتوبي, التعلّم الآلي الآلي, بحث بنية الشبكات العصبية