Clear Sky Science · ar

استخدام نموذج لغة كبير لتعزيز التفكير لدى نموذج لغة كبير آخر عبر تحديث المكافأة في GRPO

تعليم الآلات كيفية التفكير بدقة

يمكن للعديد من نماذج اللغة الحالية الدردشة والترجمة والإجابة على الأسئلة، لكنها لا تزال تواجه صعوبة في إظهار خطوات التفكير كما يفعل طالب رياضيات جيد أو محلل دقيق. تستكشف هذه الورقة كيف يمكن لنظام ذكاء اصطناعي واحد أن يُستخدم لتحسين مهارات الاستدلال لدى آخر، وكيفية القيام بذلك دون بناء مجموعات بيانات متخصصة ضخمة يدوياً. بالنسبة للقراء المهتمين بكيفية جعل الذكاء الاصطناعي أكثر موثوقية في مجالات مثل المالية أو الطب أو البحث العلمي، يقدم العمل وصفة عملية لجعل النماذج تشرح إجاباتها بوضوح وثبات أكبر.

من المستندات الخام إلى أمثلة قابلة للتعليم

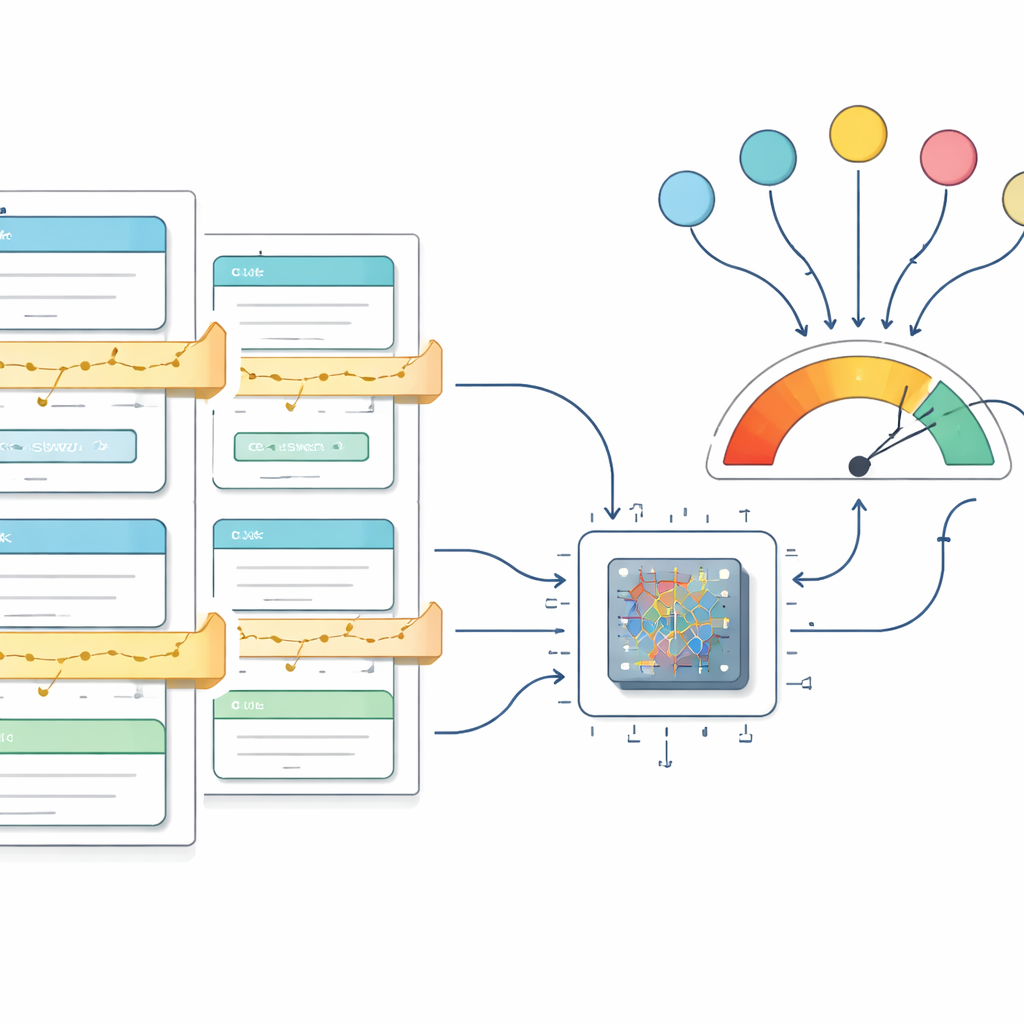

ينطلق المؤلفون من ملاحظة بسيطة: معظم المعلومات في العالم الحقيقي توجد على شكل فوضوي مثل تقارير أو رسائل المساهمين أو صفحات الويب، وليس في شكل سؤال وإجابة مرتب. لجسر هذه الفجوة، يقدمون أداتين برمجيتين، Huggify-Data ومولّد بيانات CoT. تأخذ هاتان الأداتان النص غير المهيكل وتقسماه تلقائياً إلى أزواج من الأسئلة والأجوبة، ثم تطلبان من نموذج لغة قوي أن يزوّد خطوات التفكير المفقودة بينهما. النتيجة هي ثلاثية منظمة لكل مثال: سؤال، سلسلة من التفكير، وإجابة. والأهم من ذلك أن هذه السلسلة يمكن توجيهها إلى أي مجال تقريباً، من رياضيات المدارس إلى المالية المؤسسية، مما يجعل من الممكن بناء بيانات تدريب تركز على الاستدلال دون جيوش من المشفرين البشر.

كيف يدرّب نموذج واحد نموذجًا آخر

بمجرد إنشاء ثلاثيات السؤال–التفكير–الإجابة، تُستخدم لتدريب نموذج «طالب» أصغر على التفكير بنفس الطريقة المنظمة. يُطلب من الطالب ألا يقدّم الإجابة النهائية فقط، بل أن ينتج شرحاً مفصولاً بوضوح يتبعه الاستنتاج. يُوجَّه التدريب بواسطة طريقة تُسمى تحسين السياسة النسبية المجمّعة (Group Relative Policy Optimization)، التي تقارن عدة استجابات مرشّحة لنفس السؤال وتدفع النموذج نحو الأفضل منها. تحدث الورقة هذه الطريقة بإضافة مصطلح مكافأة إضافي يتحقق مما إذا كان مخرج النموذج يتبع التنسيق المرغوب، وصولاً إلى مدى تطابقه مع مثال مرجعي مُشكّل بشكل جيد. تعاقب هذه المكافأة بلطف الشروحات المبعثرة أو الناقصة، مما يدفع النموذج نحو إجابات مرتبة وقابلة للتفسير.

تجريب المنهجية

لاختبار ما إذا كان الإطار يعمل عملياً، يطبّق المؤلفون النهج على مجموعتي بيانات مختلفتين للغاية. الأولى، GSM8K، تتألف من مسائل كلامية في مستوى المدرسة الابتدائية تتطلب استدلالاً حسابياً متعدد الخطوات. والثانية مُكوّنة من رسائل وارن بافيت السنوية إلى المساهمين، حيث الهدف هو التقاط الاستدلال المطوّل حول الاستثمار وقرارات الشركات. في كلتا الحالتين، تحول خط أنابيب المعالجة النص الخام إلى بيانات تدريب منظمة وتقوم بتحسين نموذج متوسط الحجم يُدعى Qwen 2.5. أثناء التدريب، تكافئ قاعدة تسجيل بسيطة الاستجابات الصحيحة والمنسقة جيداً؛ ومع تقدّم التعلم، يرتفع متوسط المكافأة تدريجياً ويستقر عند أقصاه النظري، ما يدل على أن النموذج قد أتقن السلوك المستهدف إلى حد كبير على بيانات التدريب.

مدى أداء النموذج المحسّن

يُقاس الأداء باستخدام «دقة الرموز المتوسّطة»، التي تسأل تقريباً أيّ جزء من قطع النص الصغيرة (الرموز) في مخرجات النموذج يطابق ما هو متوقع. وعلى الرغم من أن هذا يختلف عن طريقة التقييم التقليدية كلّها أو لا شيء لإجابات الاختبار، فهو مناسب لتقييم ما إذا كانت الشروحات والإجابات تُنتج بالبنية الصحيحة. على GSM8K، يصل أفضل نموذج إلى دقة رموز تبلغ 98.2 في المئة، وعلى رسائل بافيت يصل إلى 98.5 في المئة. هذه الدرجات أعلى من تلك المبلّغ عنها لأنظمة معروفة مثل GPT‑4 وClaude 3.5 Sonnet وفق نفس المقياس، وكل ذلك باستخدام نموذج بحجم 3 مليارات معلمة يمكن تدريبه في أقل من يومين على عتاد مستأجر. كما يشارك المؤلفون تفاصيل حول تكاليف الحوسبة وإعدادات الأجهزة، ويطلقون كل الشيفرات والنماذج ومجموعات البيانات ليطلع عليها الآخرون ويبنوا عليها.

ما يعنيه هذا للاستخدام اليومي للذكاء الاصطناعي

لغير المتخصصين، الخلاصة الرئيسية هي أن أنظمة الذكاء الاصطناعي يمكن تعليمها ليس فقط للإجابة، بل للإجابة بطريقة منضبطة وسهلة المتابعة، باستخدام بيانات مُستخرجة تلقائياً من الوثائق العادية. من خلال الجمع بين نموذج معلم غني بالتفكير، وخط أنابيب بيانات مرن، ومخطط مكافآت يُقدّر كلّاً من الصحة والوضوح، يوضح المؤلفون كيف يمكن تشكيل نماذج أصغر إلى حلول أكثر موثوقية لحل المشكلات. وعلى الرغم من إشارتهم إلى محدّدات—مثل الحاجة إلى اختبارات أقوى للفهم الحقيقي والسلامة—يشير الإطار إلى مستقبل يمكن للمنظمات فيه تحويل أرشيفات نصوصها إلى مساعدين ذكاء اصطناعي مخصّصة وشفافة للتعليم والمالية وما وراءها.

الاستشهاد: Yin, Y. Use large language model to enhance reasoning of another large language model through reward updated GRPO. Sci Rep 16, 8360 (2026). https://doi.org/10.1038/s41598-026-39296-8

الكلمات المفتاحية: نماذج اللغة الكبيرة, التفكير سلسلة-الفكر, تحسين المكافأة, تنسيق البيانات, الذكاء الاصطناعي المخصّص لمجال