Clear Sky Science · ar

تدقيق الخصوصية المشدد لـ DP-SGD في نموذج تهديد الحالة المخفية

لماذا يهم هذا في التكنولوجيا اليومية

تتعلم التطبيقات الحديثة باستمرار من بياناتنا، بدءًا من الصور والرسائل وصولاً إلى السجلات الطبية. إحدى الطرق الرائدة للحفاظ على سلامة هذا التدريب تُسمى الخصوصية التفاضلية، التي تضيف ضوضاء مضبوطة بعناية بحيث لا يبرز أي فرد بمفرده في البيانات. لكن كيف نعرف أن هذه الحمايات تعمل فعليًا في الممارسة، لا سيما بالنسبة للشبكات العصبية العميقة المستخدمة اليوم؟ يستقصي هذا البحث هذا السؤال ويبيّن متى يكون إخفاء «فيلم التدريب» الخاص بالنموذج مفيدًا للخصوصية — ومتى لا يكون كذلك.

كيف يفترض أن تعمل التعلم الخاص

خوارزمية الانحدار العشوائي التفاضلي (DP-SGD) هي الخوارزمية الأساسية لتعلم الآلة مع الحفاظ على الخصوصية. تُدرّب النماذج خطوة خطوة على دفعات صغيرة من البيانات، حيث تُقصّ قيمة التدرجات في كل خطوة (اتجاه التحسن) وتُضاف ضوضاء عشوائية قبل تحديث النموذج. توفر النظرية حدودًا علوية لمدى تأثير بيانات أي شخص على النموذج النهائي، وتُختصر هذه الحدود برقم الخصوصية الذي يُسمى غالبًا إبسلون. بالتوازي، يُحاول «تدقيق الخصوصية» مهاجمة النموذج المُدرَّب لرؤية مقدار المعلومات التي يمكن استخلاصها عمليًا. إذا اتفقت النظرية مع نتائج التدقيق، فيمكننا الوثوق بحسابات الخصوصية؛ وإذا لم تتطابق، فهناك شيء مهم مفقود.

ماذا يتغير عندما يُكشف فقط النموذج النهائي

افترضت معظم عمليات التدقيق السابقة وجود خصم قوي يمكنه رؤية كل نقاط حفظ النموذج الوسيطة أثناء التدريب. في الواقع، تُصدر العديد من المؤسسات النموذج النهائي فقط، وليس سجل التدريب الكامل. يُسمى هذا الإعداد الأكثر واقعية نموذج تهديد الحالة المخفية. أشارت أعمال نظرية حديثة إلى أنه، على الأقل للمسائل التقعرية البسيطة، قد يؤدي إخفاء النماذج الوسيطة إلى تضخيم الخصوصية مع الزمن: إذ تُـ«غسل» البيانات المستخدمة مبكرًا بواسطة تحديثات لاحقة صاخبة. ومع ذلك، يعتمد التعلم العميق الحديث على نماذج شديدة اللاتقعر، حيث تكون سطح الخسارة وعرًا ومعقدًا. لم يتضح ما إذا كان نفس التضخيم يحدث هناك — أو ما إذا كانت الهجمات الحالية ببساطة ضعيفة جدًا لفضح فقدان الخصوصية الكامل.

طريقة جديدة للخصوم لدفع النموذج

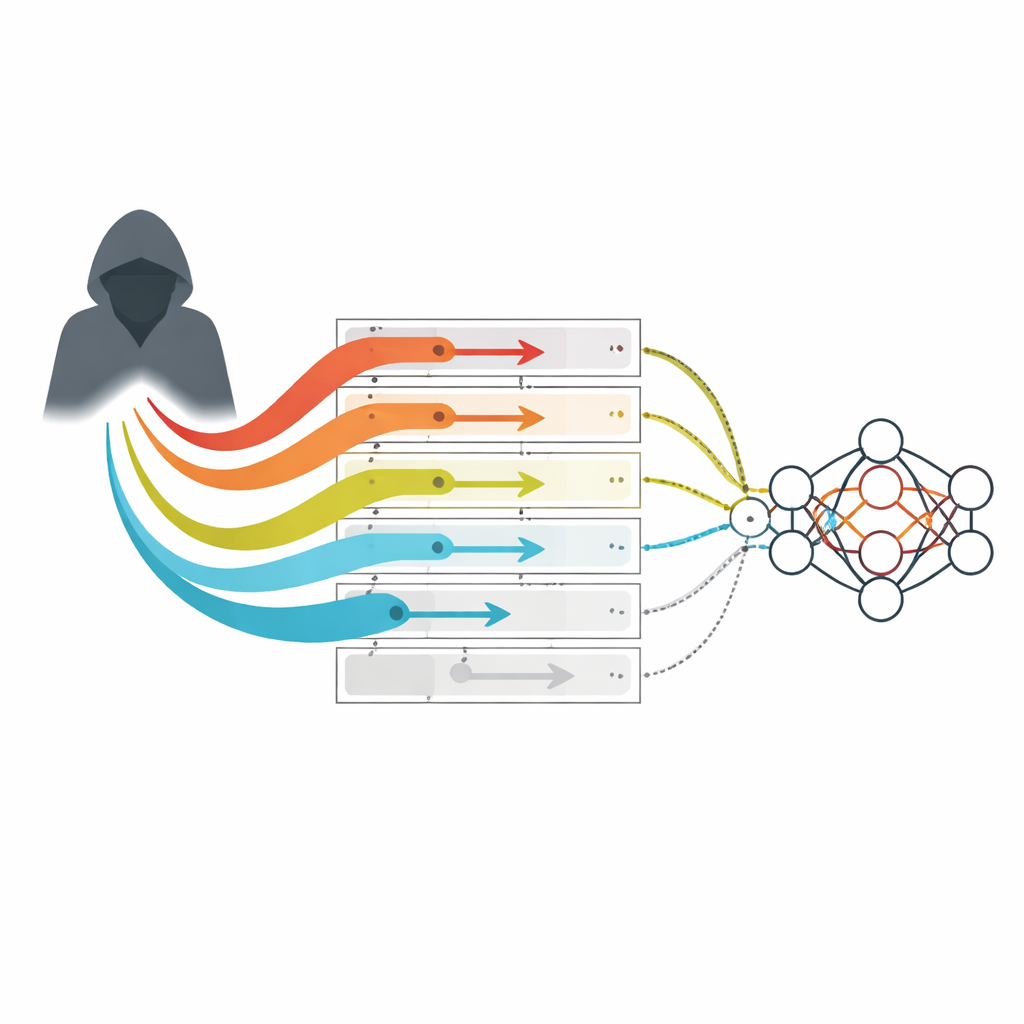

يقدّم الباحث مجموعة جديدة من الخصوم «مصممي التدرج» المكيّفة لنموذج الحالة المخفية. بدلًا من محاولة تصميم نقطة بيانات خاصة ثم مراقبة كيفية تغير خسارتها أثناء التدريب (كما في الهجمات التقليدية المبنية على الخسارة)، يصف هؤلاء الخصوم مباشرة سلسلة التدرجات التي ستُطبّق إذا وُجدت نقطة بيانات أسوأ حالة. يختارون تدرجات تصل دائمًا إلى حد القص وتتوافق مع اتجاهات معلمات نادرًا ما تُستخدم، مما يجعل تأثيرهم أسهل للاكتشاف حتى دون رؤية النماذج الوسيطة. تُدرَس نسختان بسيطتان: إحداهما تختار عشوائيًا اتجاه معلمة، والأخرى تحاكي عملية التدريب لإيجاد الاتجاه الأقل تحديثًا قبل حقن تدرجات قوية ومكررة على طوله.

ما تكشفه التجارب عن خطر الخصوصية الواقعي

باستخدام هذا الإطار، يدقق البحث أداء DP-SGD على مجموعات صور وبيانات جدولية مع معماريات شائعة مثل الشبكات الالتفافية وشبكات البقايا، فضلاً عن نموذج صغير متصل بالكامل. عندما يُستخدم التدرج المصمم في كل خطوة تدريبية، تُطابق الخصوم الجديدة حدود الخصوصية النظرية الصارمة — رغم أنهم يرون النموذج النهائي فقط. هذا يعني أنه، في هذه الحالة القصوى، لا يوفر إخفاء نقاط الحفظ الوسيطة أي خصوصية إضافية على الإطلاق. عندما يُدرَج التدرج المصمم بوتيرة أقل، يتغير المشهد: بالنسبة للدفعات الكبيرة مقارنةً بمستوى الضوضاء، تظل نتائج التدقيق قريبة من النظرية (مما يشير مرة أخرى إلى تضخيم ضئيل فعليًا)، لكن بالنسبة للدفعات الأصغر والضوضاء الأعلى، يظهر فجوة تشير إلى تضخيم حقيقي، وإن كان متواضعًا، للخصوصية في البيئات اللاتقعرية.

لمحة داخل حد أسوأ الحالات

لفهم حدود الخصوصية المطلقة في نموذج الحالة المخفية، يدرس البحث أيضًا خصمًا نظريًا أكثر تطرفًا لا يكتفي بتصميم التدرجات بل يصمم كامل سطح خسارة للحفاظ على تأثير نقطة بيانات خاصة عبر التكرارات. في هذا الإعداد المسيطر عليه، تُفصل النتائج بوضوح بين نظامين: مع أحجام دفعات كبيرة، يكون حساب الخصوصية المبني على النظرية القياسية محكمًا عمليًا، أما مع دفعات صغيرة وضوضاء كبيرة، فتُنسى معلومات البداية عن نقطة البيانات جزئيًا مع الزمن. والأهم، أن هذا التضخيم أضعف مما هو معروف للمسائل التقعرية البسيطة ولا يمحو خطر الخصوصية بالكامل أبدًا.

ماذا يعني هذا للمستخدمين والممارسين

لغير المتخصصين، الخلاصة هي أن إخفاء سجل التدريب لنموذج تعلم عميق لا يضمن سحرًا خصوصية أقوى بكثير. عندما تُستخدم بيانات الشخص بشكل متكرر جدًا أثناء التدريب، يكون خطره مقاربًا لما تتوقعه النظرية التحفظية الحالية. تظهر حماية إضافية في بعض النظم الأكثر ملاءمة — دفعات صغيرة مع ضوضاء كبيرة — لكنها متواضعة ولا تقلل الخطر إلى الصفر. تؤكد هذه النتائج أجزاء من حسابات الخصوصية الحالية وتبرز قيودها، مما يقدم صورة أوضح وأكثر واقعية عن مقدار الحماية التي يمكن أن يوفرها DP-SGD عندما يُشارك النموذج النهائي فقط.

الاستشهاد: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

الكلمات المفتاحية: الخصوصية التفاضلية, DP-SGD, تدقيق الخصوصية, أمن تعلم الآلة, نموذج الحالة المخفية