Clear Sky Science · ar

تعظيم التأثير الزمني عبر شبكات عصبية بيانية زمنية مستمرة والتعلم المعزز العميق

لماذا التوقيت مهم في عالمنا المترابط

من الفيديوهات الفيروسية إلى انتشار الأمراض، يعتمد الكثير من الحياة المعاصرة على كيفية تلاشي الأمور عبر شبكات البشر. تسعى الشركات لمعرفة من تستهدف حتى يتسع تأثير الإعلان ككرة ثلج. ويريد مسؤولو الصحة العامة معرفة من يُعطى اللقاح أولاً لوقف تفشٍ. ومع ذلك، تتعامل معظم الأدوات المستخدمة لاختيار هؤلاء الأفراد المهمين مع الشبكات كما لو كانت مجمدة زمنياً، رغم أن التفاعلات الحقيقية تظهر وتختفي لحظة بلحظة. تعرض هذه الورقة نهجاً جديداً، يسمى TempRL-IM، يأخذ تدفق الزمن على محمل الجد ويبيّن كيف أن استخدام توقيت الروابط بدقة يمكن أن يحسن كثيراً قدرتنا على توجيه المعلومات والتأثير في أنظمة اجتماعية سريعة التغير.

من خرائط ثابتة إلى شبكات حية

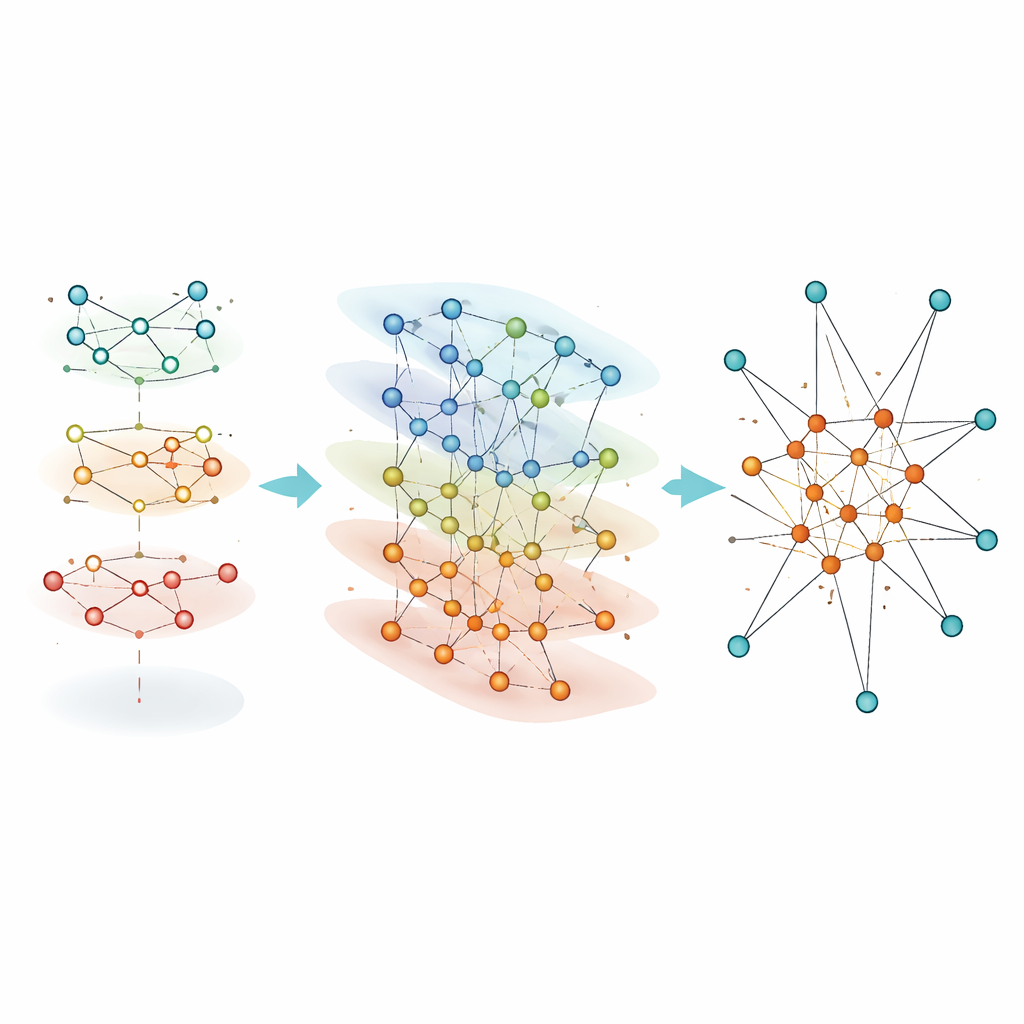

تبدأ الدراسات التقليدية للتأثير في الشبكات بسؤال بسيط: إذا كان بإمكانك اختيار مجموعة صغيرة من الأشخاص «لتنشيطهم» — ربما بإرسال عينات مجانية أو تنبيهات هامة — فمن منهم سيتسبب في أكبر سلسلة من ردود الفعل؟ أجابت الطرق الأقدم على هذا السؤال بالنظر فقط إلى لقطة ثابتة لمن يرتبط بمن. تفترض هذه الطرق أنه إذا كان الشخص أ مرتبطاً بالشخص ب، فهذه الرابطة متاحة دائماً لانتقال التأثير. لكن الأنظمة الحقيقية نادراً ما تكون مستقرة بهذا الشكل. تتصاعد وتضعف تبادلات البريد الإلكتروني، والمكالمات الهاتفية، والرسائل الإلكترونية، واللقاءات الشخصية طوال اليوم. إن تجاهل هذا الإيقاع قد يؤدي إلى اختيارات سيئة، مثل اختيار شخص يبدو مركزياً على الورق لكنه في الواقع غير نشط خلال النافذة الزمنية الحاسمة التي يجب أن ينتشر خلالها التأثير.

الاستماع إلى نبض التفاعل

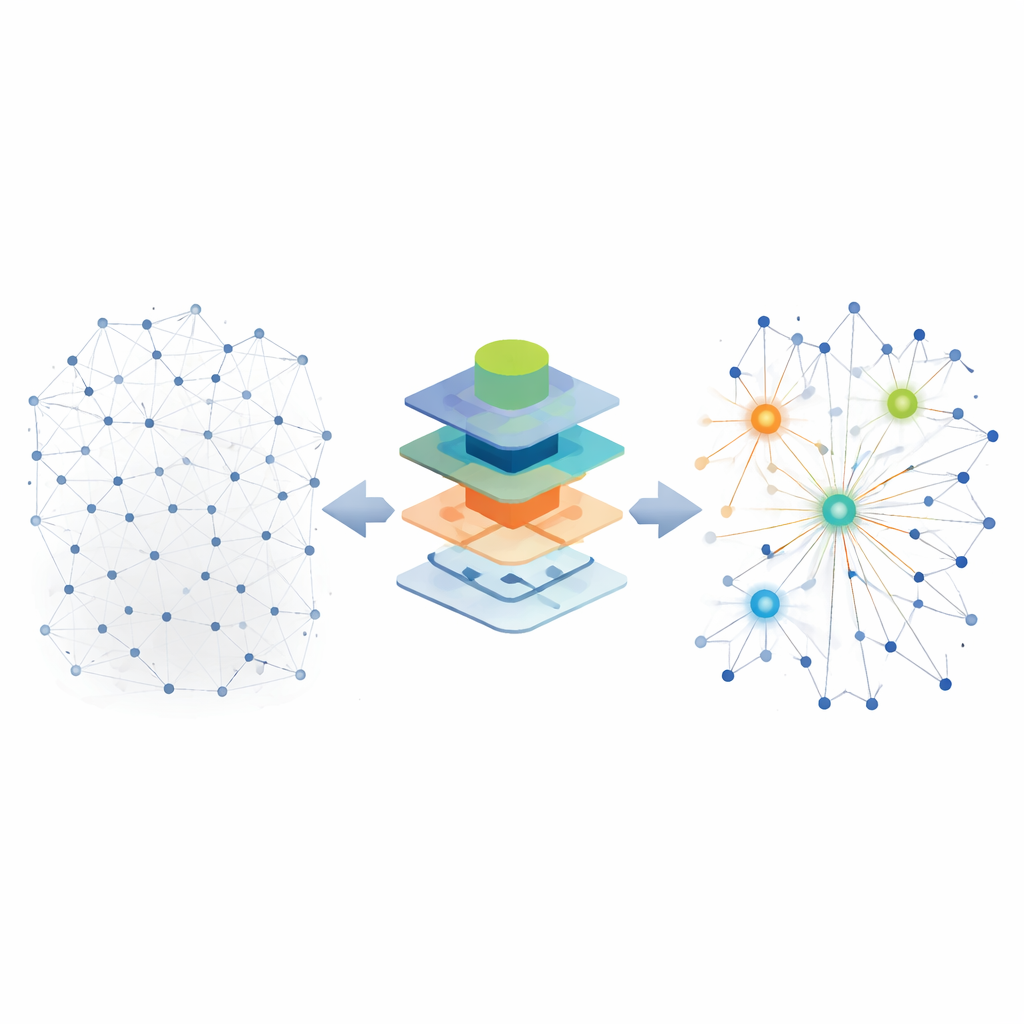

يجادل المؤلفون بأن اللحظات الدقيقة التي يتفاعل فيها الناس — حتى من حيث ترتيب وتباعد الأحداث — تحمل دلائل حيوية عمن هو المؤثر فعلاً. يعامل إطارهم TempRL-IM كل تواصل في الشبكة كحدث مؤرّخ زمنياً، مثل إدخال في سجل مفصّل. وبدلاً من تقطيع الزمن إلى شرائح خشنة، يستخدم شبكة عصبية بيانية زمنية مستمرة، وهو نوع من نماذج التعلم الآلي التي تحتفظ بذاكرة لكل شخص في الشبكة. في كل مرة يتفاعل فيها شخصان، تُحدَّث ذاكرتهما، مع الأخذ في الاعتبار ليس فقط من تحدث مع من، بل أيضاً مدى التكرار وموعده الأخير. ثم يركز آلية انتباه زمنية على الجيران واللحظات الماضية الأهم، مُلخِّصة حالة كل شخص المتغيرة إلى بصمة رقمية موجزة.

تعليم الذكاء الاصطناعي اختيار الرسل المناسبين

بمجرد ترميز أنماط الشبكة المتغيرة، يمرر TempRL-IM هذه البصمات إلى وحدة اتخاذ قرار تعتمد على التعلم المعزز العميق. هنا، يتعلم عامل الذكاء الاصطناعي عبر التجربة والخطأ اختيار مجموعة صغيرة من الأفراد «البذور» في زمن ملاحظة محدد. في محاكاة لكيفية انتشار التأثير بعد تلك اللحظة، يتلقى العامل مكافآت أعلى عندما تؤدي البذور التي يختارها إلى موجات كبيرة. عبر جولات عديدة، يكتشف استراتيجيات زمنية دقيقة — على سبيل المثال، تفضيل الأشخاص الذين يصبحون نشطين تماماً عندما تُطلق حملة، أو أولئك الذين تتجمع اتصالاتهم خلال فترات محورية. والأهم أن النموذج يحترم السببية: فهو لا يتطلع أبداً إلى المستقبل عند تكوين قراراته، معتمداً فقط على الأحداث الماضية والحالية.

إثبات الفوائد على بيانات العالم الحقيقي

لاختبار TempRL-IM، طبّقه الباحثون على ست شبكات زمنية حقيقية، شملت تبادلات البريد الإلكتروني في شركات، ورسائل خاصة على منصات جامعية، وعلاقات ثقة في سوق عملة رقمية، والتقارب المادي بين مستخدمي الهواتف المحمولة. قارنوا طريقتهم بخوارزميات ثابتة ومعتمدة على لقطات زمنية شائعة، بالإضافة إلى أساليب التعلم العميق الحديثة. عبر جميع مجموعات البيانات وبأعداد بذور مختلفة، فعلَّل TempRL-IM المزيد من الأفراد باستمرار — عادةً بنسبة 15 إلى 28 بالمئة أكثر من أقوى المنافسين المعتمدين على التعلم — مع اختيار بذور أسرع ثلاث إلى عشر مرات في وقت اتخاذ القرار. كما صمدت الطريقة في ظل ظروف ضوضاء تم فيها حذف بعض التفاعلات أو تغيير توقيتها أو تكثيفها فجأة، وانتقلت جيداً من شبكة إلى أخرى ذات أنماط نشاط مشابهة.

ما الذي يعنيه هذا للتطبيقات اليومية

بعبارات بسيطة، تُظهر هذه الدراسة أن من تختاره للتأثير ليس مسألة مكانهم في الشبكة فحسب، بل أيضاً متى يكونون متصلين. من خلال نمذجة الشبكات ككيانات حية وواعية زمنياً وتدريب ذكاء اصطناعي على استغلال هذه الأنماط الزمنية، يمكن لـ TempRL-IM تحديد رُسُل أفضل للتسويق، وأهداف مبكرة للحملات التطعيمية أو التوعوية، ونقاط تحكم أكثر فعالية في أنظمة الاتصال أو النقل. الخلاصة الأساسية بسيطة: التوقيت والتسلسل مهمان، والأدوات التي تحتضن الجدول الزمني الكامل لتفاعلاتنا يمكنها اتخاذ قرارات أذكى وأسرع في الشبكات المعقدة والمتغيرة باستمرار التي تشكل حياتنا.

الاستشهاد: Wang, Y., Alawad, M.A., Alfilh, R.H.C. et al. Temporal influence maximization via continuous-time graph neural networks and deep reinforcement learning. Sci Rep 16, 8987 (2026). https://doi.org/10.1038/s41598-026-37640-6

الكلمات المفتاحية: تعظيم التأثير, الشبكات الاجتماعية الديناميكية, الشبكات العصبية البيانية, التعلم المعزز, انتشار المعلومات