Clear Sky Science · ar

RiemannInfer: تحسين استدلال المحولات عبر الهندسة الريمانية

لماذا يهم هذا لمستخدمي الذكاء الاصطناعي اليوميين

تستطيع برامج الدردشة والمساعدون الذكيون الحاليون حل مسائل رياضية، وكتابة مقالات، وحتى شرح موضوعات طبية، ومع ذلك لا نزال لا نعرف حقًا كيف يصلون إلى استنتاجاتهم—أو كيف نجعل استدلالهم أكثر موثوقية. تقدم هذه الورقة "RiemannInfer"، طريقة جديدة لاستكشاف داخل نماذج اللغة الكبيرة عن طريق اعتبار نشاطها الداخلي حركة على سطح هندسي منحني. هذه النظرة لا تمنحنا صورة أكثر بديهية عن كيفية تفكير هذه الأنظمة فحسب، بل تجعل استدلالها أسرع وأكثر دقة.

تحويل تفكير الذكاء الاصطناعي إلى رحلة هندسية

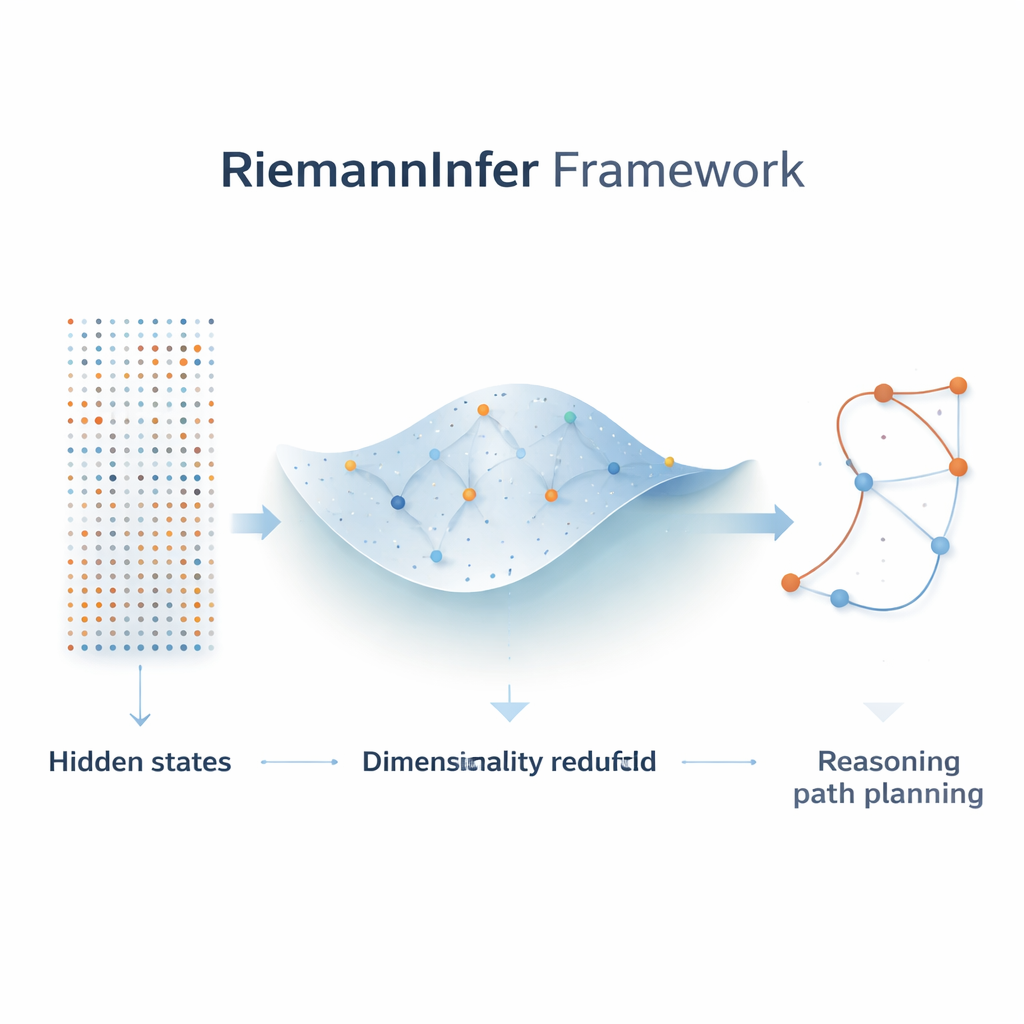

داخل نموذج لغة كبير مثل GPT-4 أو Llama، يُمثّل كل كلمة في جملة بواسطة متجه عالي الأبعاد، وتُحدد طبقات "الانتباه" مدى تأثر الكلمات ببعضها. يلاحظ المؤلفون أن هذه الحالات المخفية يمكن اعتبارها نقاطًا في فضاء شاسع يشفر شكله العام فهم النموذج للغة. بدلًا من التعامل مع الاستدلال كسلسلة من حسابات الاحتمال على النصوص، يعيدون تفسيره كمشكلة بحث عن مسار: يسافر النموذج من حالة ابتدائية (السؤال) إلى حالة نهائية (الإجابة) على طول مسار في هذا الفضاء. باستخدام أدوات من الهندسة الريمانية—رياضيات الأسطح المنحنية—يبنون منحنى يلتقط كيف تنحني وتتمدّد أنماط الانتباه هذا المشهد الداخلي.

ضغط التعقيد دون فقدان الصورة الكبرى

نظرًا لأن الفضاء الداخلي الخام لنموذج اللغة كبير جدًا، الخطوة الأولى في RiemannInfer هي تقليصه مع الحفاظ على بنيته الأساسية. يجمع المؤلفون تقنيات من الطوبولوجيا، التي تدرس كيفية ارتباط النقاط، مع خوارزمية شعبية لتقليل الأبعاد تُسمى UMAP. قبل تقليص عدد الأبعاد، يحللون "شكل" سحابة الحالات المخفية للتأكد من بقاء أنماط الاتصال الأساسية بعد الضغط. النتيجة هي فضاء منخفض الأبعاد حيث تُحفظ العلاقات المهمة بين الرموز—مثل أي الكلمات تولي انتباهًا قويًا لبعضها—إلى حد كبير. تجعل هذه الخريطة الهندسية المدمجة من الممكن إجراء حسابات دقيقة على المسافات والمسارات الأقصر والانحناء.

بناء خريطة منحنية من الانتباه

الابتكار الأساسي هو ترجمة أوزان الانتباه إلى مقياس هندسي للمسافة. عندما يمنح النموذج اهتمامًا قويًا بين رمزين، تعاملهم RiemannInfer على أنهم قريبون من بعضهم على المنحنى؛ والاهتمام الضعيف يضعهم أبعد. من هذه العلاقات، يعرّف المؤلفون مقياسًا—قاعدة رياضية تحدد الأطوال والزوايا—ويستخدمونه لحساب الجيوبسكس، المعادل المنحني للخطوط المستقيمة، وكذلك الانحناء الذي يقيس مدى انثناء الفضاء. يتحول الانتباه متعدد الرؤوس بشكل طبيعي إلى مزيج من مقاييس متعددة، كل منها يلتقط جانبًا مختلفًا من البنية اللغوية، مثل القواعد أو المعنى. مع هذا البناء، يمكن تفسير قرارات النموذج على أنها اختيار مسارات معينة عبر منظر تعكس قممه وقيعه اماكن تركز أو ندرة المعلومات.

التخطيط لمسارات استدلال قليلة المجهود

بمجرد بناء المنحنى، يعيد المؤلفون صياغة الاستدلال على أنه العثور على مسار "سهل" من السؤال إلى الإجابة—المسار الذي يقلل العمل الكلي المبذول على طول الطريق. يستعيرون تمثيلاً من تسلق الجبال: صعود طريق حاد ومشقج يحتاج طاقة أكبر من اتباع حافة أكثر سلاسة إلى نفس القمة. في سياق نماذج اللغة، يلعب الانحناء دور الانحدار، ويقابل عمل النموذج في الاستدلال مقدار تقليل عدم اليقين الداخلي على طول المسار. باستخدام صيغ تقريبية للجيبسكس والانحناء، مضافة إلى خوارزمية بحث على رسم بياني فعالة (خوارزمية ديكسترا)، يحدد RiemannInfer بسرعة المسارات التي تقلل هذا العمل، موجهًا النموذج عمليًا نحو سلاسل تفكير أكثر كفاءة.

ماذا تظهر التجارب على النماذج الحقيقية

يختبر المؤلفون RiemannInfer على عدة نماذج لغة متقدمة، بما في ذلك GPT-4o وLlama-3-405B وDeepSeek-V2-400B، عبر مجموعات اختبارات صعبة في الرياضيات والاستدلال مثل GSM8K وMATH500 وStrategyQA وAGIEval. في كل حالة، يزيد تغليف هذه النماذج بإطار RiemannInfer دقتها ببضعة نقاط مئوية—أرقام صغيرة لكنها ذات معنى على خط الأداء المتقدم—مع الحفاظ على السرعة أو تحسينها قليلاً. تظهر مقارنة مع طريقة أبسط خطية خالصة أن تجاهل الهندسة المنحنية للحالات المخفية يضر بالأداء بشدة، مما يؤكد أهمية النظر إلى المنحنى.

الصورة الكبرى: منح الاستدلال في الذكاء الاصطناعي ملمسًا فيزيائيًا

للقارئ العام، الخلاصة الأساسية هي أن المؤلفين حولوا الأعمال الداخلية الغامضة لنماذج اللغة الكبيرة إلى شيء أكثر ملموسًا: رحلة عبر منظر منحني حيث يتوافق التفكير الجيد مع اتباع دروب سلسة قليلة المجهود. من خلال تأصيل أنماط الانتباه وخطوات الاستدلال في مفاهيم هندسية وفيزيائية—المسافة والانحناء والعمل—يقدم RiemannInfer وسيلة عملية لتحسين النتائج وجسرًا مفاهيميًا بين الذكاء الاصطناعي وفيزياء المساحات المستمرة. رغم أن الطرق الحالية تقريبية ولا تزال العديد من التفاصيل بحاجة إلى صقل، فإن هذا الإطار يشير إلى أنظمة ذكاء اصطناعي مستقبلية يمكن تحليل عمليات تفكيرها وتحسينها وربما حتى تصميمها باستخدام لغة الهندسة والفيزياء.

الاستشهاد: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

الكلمات المفتاحية: نماذج اللغة الكبيرة, التعلم العميق الهندسي, المنحنى الريماني, آليات الانتباه, كفاءة الاستدلال