Clear Sky Science · ar

انحراف التفسير في الذكاء الاصطناعي القابل للتفسير تحت ضجيج الوسوم

لماذا يمكن أن تختلّ تفسيرات الذكاء الاصطناعي بهدوء

يعتمد كثير من الناس اليوم على الذكاء الاصطناعي ليس فقط للحصول على إجابات، بل أيضاً لأسبابها: لماذا رُفض الطلب على قرض؟ لماذا صنفت النظام مريضاً على أنه عالي المخاطر؟ تُظهر هذه الدراسة أنه حتى عندما تبدو دقة النموذج مطمئنة ومستقرة، يمكن أن تتغير القصة التي يرويها حول سبب اتخاذه لقرار بشكل كبير إذا احتوت بيانات التدريب على أخطاء. ذلك التحول الخفي في التفسيرات — الذي يسميه المؤلفون «انحراف التفسير» — قد يضلّل الممارسين الذين يعتمدون على الذكاء الاصطناعي لتبرير قرارات مهمة.

عندما تلتقي البيانات النظيفة بتسميات فوضوية

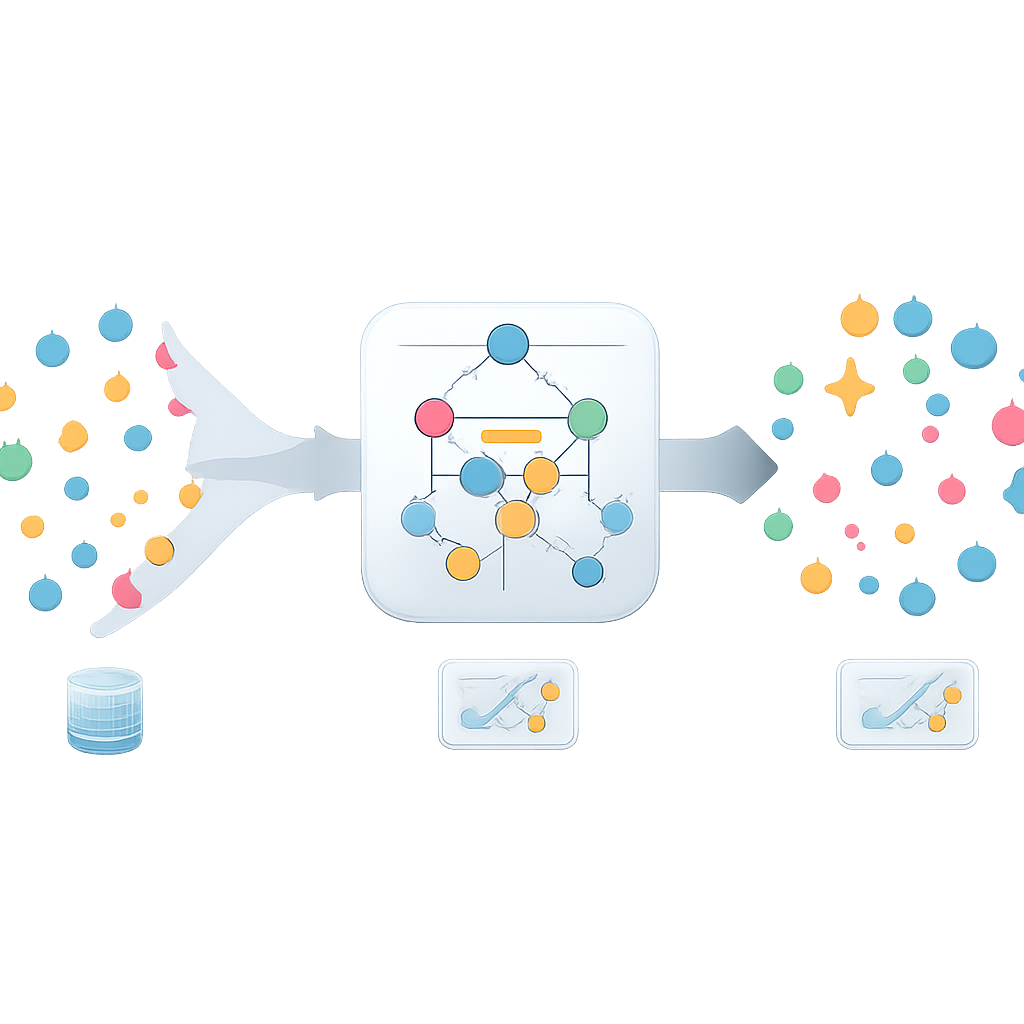

معظم أنظمة الذكاء الاصطناعي الحديثة تُعد «صناديق سوداء»، تقدّم تنبؤات بدون أسباب واضحة. لجعل الذكاء الاصطناعي أكثر شفافية، يلجأ العديد من التطبيقات إلى نماذج قائمة على القواعد تشبه التفكير البشري بصيغة «إن–فإن»: على سبيل المثال، «إذا كان ضغط الدم مرتفعاً والعمر يزيد عن 60، إذن الخطر مرتفع». هذه المجموعات من القواعد جذابة بشكل خاص في مجالات حساسة مثل الرعاية الصحية والقانون والمالية، حيث يحتاج المستخدمون إلى فحص المنطق والثقة به. لكن البيانات الواقعية نادراً ما تكون مثالية. إحدى المشكلات الشائعة هي ضجيج الوسوم—حالات يكون فيها ما يُفترض أنه «الإجابة الصحيحة» في بيانات التدريب خاطئاً، مثل تشخيص مسجل بشكل خاطئ أو وسم نتيجة عميل بشكل غير دقيق. بينما يُعرف أن ضجيج الوسوم يضرّ بجودة التنبؤ، لم تُدرس تأثيراته على استقرار تفسيرات الذكاء الاصطناعي بشكل منهجي من قبل.

اختبار مدى ثبات التفسيرات تحت الضجيج

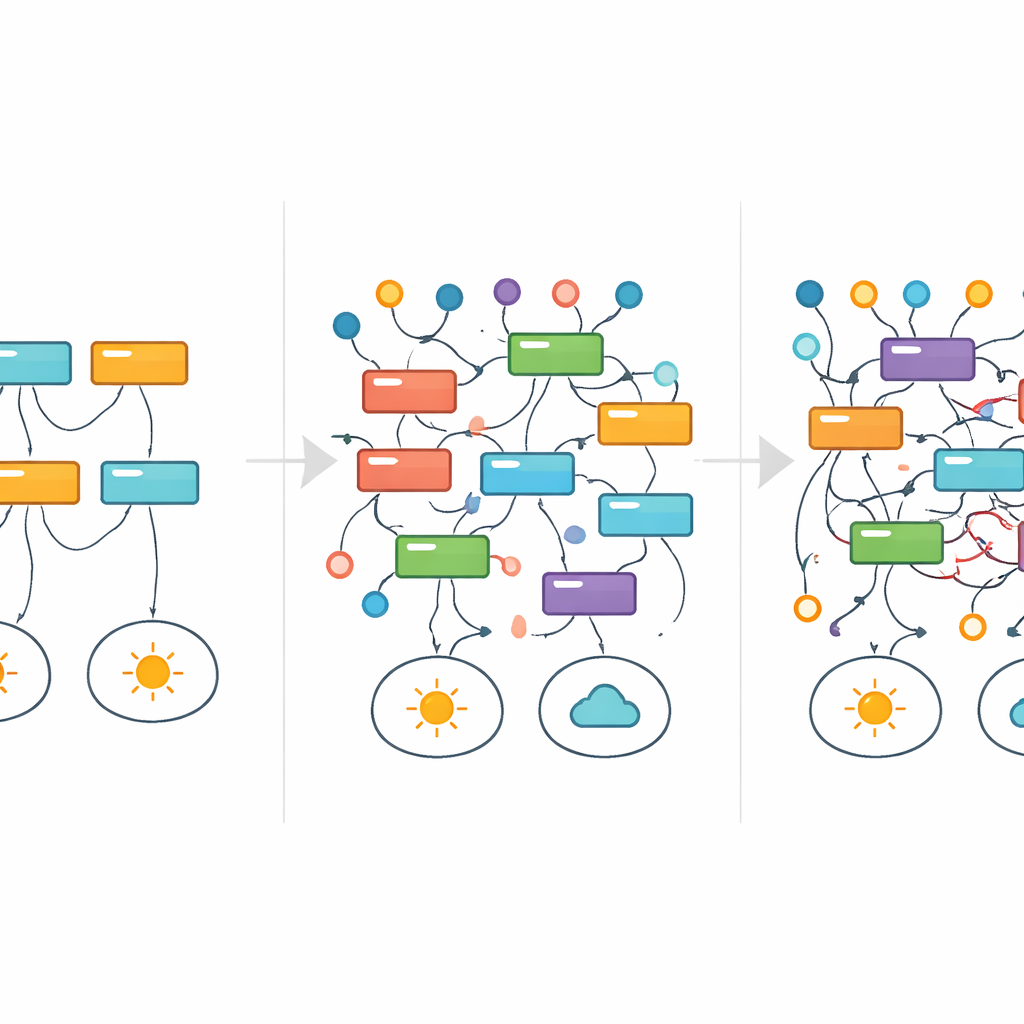

قيّم المؤلفون مدى صمود تفسيرات القواعد عندما تُفسد الوسوم تدريجياً. استخدموا أربع مجموعات بيانات مختلفة من مجالات الرعاية الصحية والمصرفية وأمراض الكبد وحتى نظرية الأعداد، كلها مُعدة كمهام تنبؤ بنعم–لا. تمت مقارنة ثلاث طرق لتعلّم القواعد: خوارزميتان شائعتان وسريعتان (IREP وRIPPER) ونهج أكثر احتسابية يُسمى نماذج المعرفة البشرية (HKM)، والذي يهدف صراحة إلى إنتاج مجموعات قواعد بسيطة للغاية ومماثلة للطريقة البشرية في التفكير. لكل طريقة، درّب الباحثون النماذج بشكل متكرر بينما كانوا يقلبون عشوائياً جزءاً متزايداً من تسميات التدريب—من بيانات تكاد تكون نظيفة تماماً وصولاً إلى هراء شبه كامل. وتتبعوا شيئين بالتوازي: مدى استمرار النماذج في التنبؤ بشكل جيد على مجموعة اختبار نظيفة، وإلى أي مدى تغيّرت القواعد المتعلّمة مقارنةً بتلك المستخلصة من بيانات خالية من الضجيج.

ثبات الدقة، وتبدّل المنطق

على السطح، يمكن أن تُطمئن النتائج المستخدمين بشكل كاذب. لمستويات الضجيج المتوسطة، لا سيما مع طريقة HKM، بدت الأداء التنبؤي مستقراً نسبياً عند قياسه بمؤشر F1 الشائع. ومع ذلك، كشف النظر عن كثب إلى مجموعات القواعد قصة مختلفة. باستخدام مقياس تشابه يقارن مجموعات القواعد، وجد المؤلفون أن حتى كميات معتدلة من ضجيج الوسوم سريعا ما أضعفت التداخل بين التفسيرات الأصلية وتلك الناتجة عن الضجيج. بعبارة أخرى، قد يظل النموذج صحيحاً في كثير من الحالات، لكنه يقدّم أسباباً مختلفة بشكل متزايد. كانت مجموعات القواعد الأكثر تعقيداً هشة بشكل خاص: كلما زاد عدد الشروط في القاعدة، كانت التغييرات الصغيرة في البيانات أكثر قدرة على تفتيت تلك القواعد أو استبدالها، ما يسارع فقدان ثبات القابلية للتفسير.

متابعة القواعد وهي تظهر وتختفي

لتصوير كيفية بقاء التفسيرات الفردية أو فشلها مع تزايد الضجيج، استعان الباحثون بأداة من الطب: تحليل البقاء. بدلاً من تتبّع بقاء المرضى مع مرور الوقت، تتبعوا إلى متى استمرت قاعدة معيّنة في الظهور بين أفضل النماذج كلما زاد ضجيج الوسوم. لم تندثر العديد من القواعد بلطف، بل كانت تومض بالظهور والاختفاء—علامة على أن تفسيرات مختلفة تماماً قد تسود عند مستويات ضجيج مختلفة، حتى لنفس المهمة الأساسية. في مجموعة بيانات بسيطة عن قابلية القسمة للأعداد، على سبيل المثال، استُبدلت القواعد النظيفة والصحيحة رياضياً تدريجياً بتقريبات أوسع وفي النهاية بأنماط متداخلة ويبدو أنها اعتباطية لكنها لا تزال تتوافق مع الوسوم المفسدة. طوال جزء كبير من هذه العملية، لم تُشير مقاييس الأداء الرئيسية بوضوح إلى وجود مشكلة.

ماذا يعني هذا لمن يعتمدون على الذكاء الاصطناعي

الرسالة الأساسية هي أن الذكاء الاصطناعي «الموثوق» لا يمكن الحكم عليه بالدقة وحدها. حتى النماذج التي تعرض منطقها في قواعد قابلة للقراءة البشرية يمكن أن تغيّر أسبابها بهدوء عندما تكون الوسوم التي تتعلم منها غير كاملة—وهو بالضبط الحال في معظم قواعد البيانات الواقعية. يجادل المؤلفون بأن المطورين والجهات المنظمة يجب أن يعاملوا ثبات التفسير كمتطلب من الدرجة الأولى، إلى جانب الدقة والعدالة. ستكون المقاييس الجديدة التي تقيس مباشرة مدى ثبات تفسيرات النموذج تحت الضجيج، والأدوات التي تنبه المستخدمين إلى انحراف التفسير، أساسية إذا أردنا أن تكون قصص أنظمة الذكاء الاصطناعي عن العالم موثوقة بقدر تنبؤاتها.

الاستشهاد: Raikovskaia, A., Rakhimzhanov, N. & Pianykh, O.S. Interpretation drift in explainable AI under label noise. Sci Rep 16, 8528 (2026). https://doi.org/10.1038/s41598-026-37070-4

الكلمات المفتاحية: الذكاء الاصطناعي القابل للتفسير, ضجيج الوسوم, قابلية تفسير النموذج, نماذج تعتمد على القواعد, انحراف التفسير