Clear Sky Science · ar

تعزيز مقاومة الهجمات في التخزين المؤقت الدلالي لأنظمة الاسترجاع المعزَّز بالتوليد الآمن

لماذا تهم ذاكرة الذكاء الاصطناعي الأكثر ذكاء

مع دخول الدردشات والمساعدين بالذكاء الاصطناعي إلى أماكن العمل والفصول الدراسية وحتى المستشفيات، يعتمدون بشكل متزايد على حيلة تُعرف بـ«تذكّر» الأسئلة السابقة حتى يتمكنوا من الإجابة عن الأسئلة المماثلة بسرعة وبتكلفة أقل. هذه الذاكرة، المسماة التخزين المؤقت الدلالي، يمكن أن تقلل التكاليف والتأخيرات بشكل ملحوظ—لكنها قد تفتح أيضاً باباً خلفياً للمهاجمين لخداع الأنظمة وكشف أسرار أو إعطاء إجابات خاطئة. تستكشف هذه الورقة تلك المخاطر الخفية وتعرض تصميمًا جديدًا، SAFE-CACHE، يهدف إلى الحفاظ على سرعة ذاكرة الذكاء الاصطناعي مع جعل إساءة الاستخدام أصعب بكثير.

كيف تعيد مساعدين الذكاء الاصطناعي اليوم استخدام الإجابات السابقة

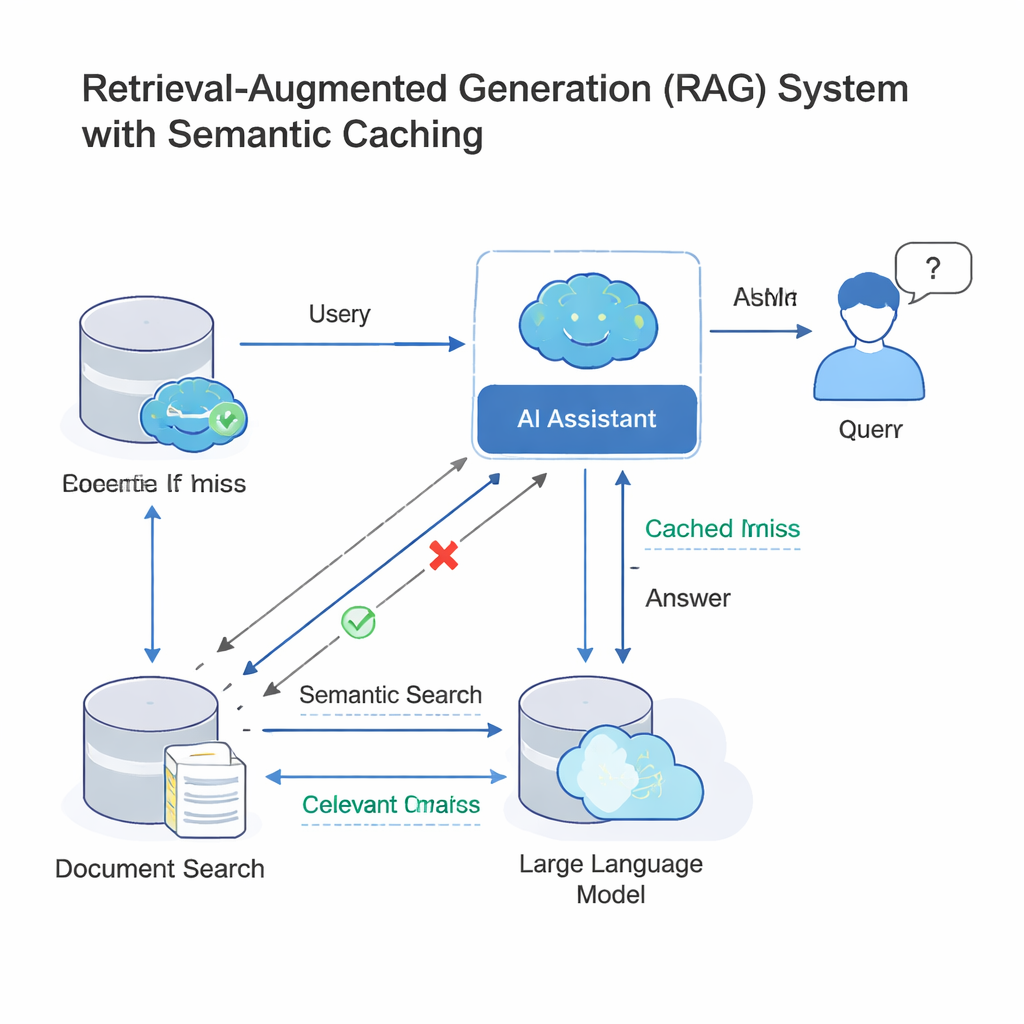

غالبًا ما تعمل نماذج اللغة الكبيرة الحديثة داخل إعداد يُدعى التوليد المعزَّز بالاسترجاع (RAG). عندما تطرح سؤالاً، يبحث النظام أولاً عن مستندات ذات صلة ثم يطلب من نموذج اللغة الكبيرة صياغة إجابة باستخدام تلك المواد. وبما أن العديد من الأشخاص يطرحون نفس السؤال تقريبًا بصيغ مختلفة، تضيف الشركات الآن تخزينًا مؤقتًا دلاليًا: مخزنٍ للأسئلة والإجابات القديمة، بالإضافة إلى بصمات رياضية لمعانيها. عند ورود استعلام جديد، يتحقق النظام مما إذا كانت بصمته «قريبة بما يكفي» إلى بصمة موجودة بالفعل في التخزين المؤقت؛ إذا كان الأمر كذلك، يعيد استخدام الإجابة القديمة بدلاً من تشغيل عملية البحث والتوليد الكاملة مرة أخرى. هذه الفكرة، المطبّقة في أدوات مثل GPTCache ومنصات سحابية من مايكروسوفت وجوجل، توفر المال وتسريع الاستجابات في روبوتات دعم العملاء، وأدوات الدردشة المؤسسية، وخدمات الذكاء الاصطناعي عالية الحركة الأخرى.

عندما يتحول الصياغ الذكي إلى ثغرة أمنية

يمكن أن يتحول الاختصار نفسه الذي يعزز السرعة إلى سلاح ضد النظام. يمكن للمهاجمين صياغة استعلامات تبدو متشابهة في البنية لكنها تعني شيئًا مختلفًا—تغيير تاريخ، أو استبدال شخص أو مكان، أو قلب معنى السؤال. وبما أن التخزينات المؤقتة الحالية تثق في التشابه الرقمي للتضمينات (تلك البصمات للمعنى)، يمكن لاستعلام خبيث أن «يصطدم» باستعلام بريء في فضاء المتجهات هذا، على الرغم من أن النية اختلفت. قد يتسبب هذا الاصطدام في إعادة التخزين المؤقت للإجابة الخاطئة، مما يعرّض معلومات سرية أو يسمح بتخزين بيانات ضارة لإعادة استخدامها لاحقًا. قد أظهرت أعمال سابقة أن قواعد بيانات المتجهات والتخزينات المؤقتة الدلالية يمكن تسميمها بهذه الطريقة، خاصة عندما يشارك العديد من المستخدمين نفس التخزين الأساسي في أنظمة متعددة المستأجرين.

تحويل الأسئلة المتناثرة إلى مجموعات نوايا مستقرة

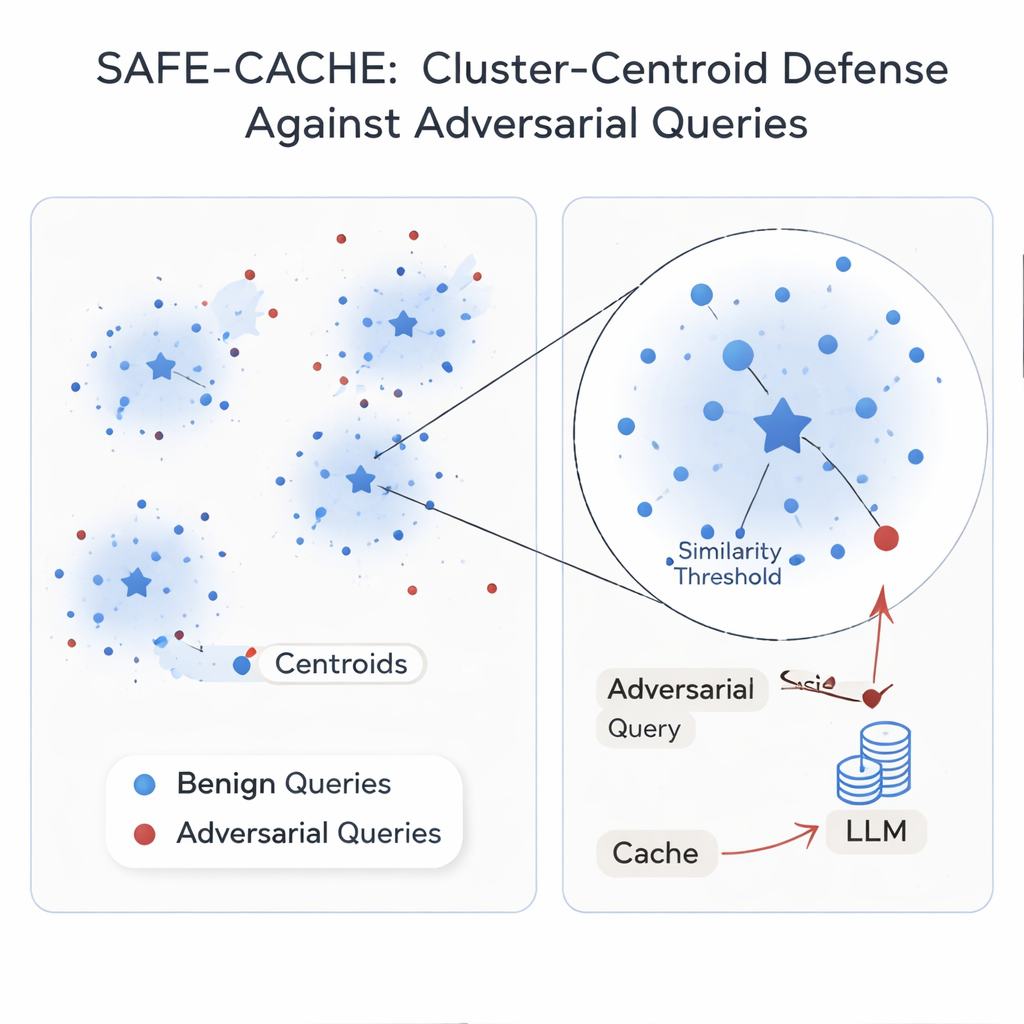

يجادل المؤلفون بأن المشكلة الجذرية هي معاملة كل استعلام على حدة. حلهم، SAFE-CACHE، يجمع أزواج السؤال–الإجابة السابقة في مجموعات تمثل النوايا الأساسية—مثل «من فاز بسباق مجلس شيوخ أريزونا 2022؟» أو «ما سعر برنامج القيادة الذاتية الكاملة من تسلا؟» بدلاً من مطابقة الاستعلامات الجديدة مباشرةً مع أمثلة قديمة فردية، يقارن SAFE-CACHE الاستعلامات بمركز كل مجموعة، أو ما يُسمى المركزية. لبناء هذه المجموعات، يُضمّن أولًا كل سؤال زائد إجابته بالكامل (وليس السؤال وحده) بحيث تُؤثر الاختلافات في الردود—مثل الرفض لكشف بيانات حساسة—أيضًا في تشكيل التجمعات. ثم يستخدم خوارزمية اكتشاف المجتمع لإيجاد مجموعات طبيعية واختبارات إحصائية لوضع علامة على المجموعات الضوضائية التي قد تخلط نوايا مختلفة أو إدخالات عدائية. تُنظف هذه المجموعات المشتبه بها وتُقسّم باستخدام ثنائي-مُرمِّز مدرَّب خصيصًا تعلم تجميع الأمثلة الصادقة وفصل الأمثلة المسممة.

تدريب نموذج صغير لتعزيز ذاكرة الذكاء الاصطناعي

تظهر بعض النوايا مرات قليلة فقط في حركة المرور الحقيقية، مما يجعل مجموعاتها هشة. لتثبيتها، يستخدم SAFE-CACHE نموذج لغة خفيف مُعدّل (نسخة من Gemma-3 بحجم مليار معلمة) لتوليد إعادة صياغات تحافظ على نفس النية بينما تغيّر الصياغة. تجعل هذه الأمثلة الإضافية المجموعات أكثر كثافة ومراكزها أكثر موثوقية، دون الحاجة إلى تدخل بشري لوسم آلاف المتغيرات. عند التشغيل، يُضمّن كل استعلام جديد ويُقارن بهذه المراكز. إذا كان تشابهه مع أفضل مركز مطابق فوق عتبة مضبوطة بعناية، تُعاد الإجابة المخزنة؛ وإلا، يعود النظام إلى خط أنابيب RAG الكامل ويقرر لاحقًا كيفية تجميع الزوج الجديد. في تجارب استخدمت طرق هجوم قوية مبنية على إعادة الصياغة المتحولة وGPT‑4.1، قلّل SAFE-CACHE محاولات التسميم الناجحة بنسبة تقارب الثلثين إلى ثلاثة أرباع مقارنة بتصميم على غرار GPTCache، مع الحفاظ على سرعة الاستجابة دون تغيير جوهري.

ماذا يعني هذا لمستخدمي الذكاء الاصطناعي اليوميين

لغير المتخصصين، الخلاصة هي أن إعطاء أنظمة الذكاء الاصطناعي «ذاكرة» ليس مجانيًا: التصاميم الساذجة قد تكشف أسرارًا أو تُخدع لنشر إجابات خاطئة. تُظهر SAFE-CACHE أنه من خلال تنظيم الذاكرة حول أنماط أعمق على مستوى النية وتعزيز تلك الأنماط بإعادة صياغات مستهدفة، من الممكن الحفاظ على مزايا السرعة والتكلفة للتخزين المؤقت الدلالي مع تقليل مخاطر الهجوم بشكل حاد. مع تحوّل مساعدين الذكاء الاصطناعي إلى بوابة أمامية للبيانات الحساسة—من سجلات الشركات إلى المعلومات الشخصية—ستكون نهجيات مثل SAFE-CACHE مفتاحية لضمان ألا تُستخدم ذاكرة الذكاء الاصطناعي بسهولة ضدّنا.

الاستشهاد: Afiffy, M., Fakhr, M.W. & Maghraby, F.A. Enhancing adversarial resilience in semantic caching for secure retrieval augmented generation systems. Sci Rep 16, 5936 (2026). https://doi.org/10.1038/s41598-026-36721-w

الكلمات المفتاحية: التخزين المؤقت الدلالي, التوليد المعزَّز بالاسترجاع, هجمات عدائية, دفاع قائم على التجميع, أمن نماذج اللغة الكبيرة