Clear Sky Science · ar

محسّن موزّع نورماليّ معمّم مع طريقة إصلاح بتوزيع غاوسي وتعلّم عكسي كوشي لاختيار الميزات

لماذا اختيار البيانات المناسبة مهم

الحياة الحديثة تعمل بالبيانات، من الصور الطبية وسجلات البنوك إلى خلاصات وسائل التواصل الاجتماعي. لكن المزيد من البيانات ليس بالضرورة أفضل. عندما يُطلب من الحواسيب أن تتعلّم من آلاف القياسات الخام دفعة واحدة، قد تصبح أبطأ، وأكثر تكلفة للتشغيل، ومن المفاجئ أن تكون أقل دقّة. تعرض هذه الورقة طريقة أذكى لفرز كل تلك القياسات والاحتفاظ فقط بتلك التي تهم فعلاً، باستخدام خوارزمية جديدة تسمى المحسّن الثنائي التكيّفي لموزّع نورمالي معمّم (BAGNDO).

مشكلة وجود الكثير من الأدلة

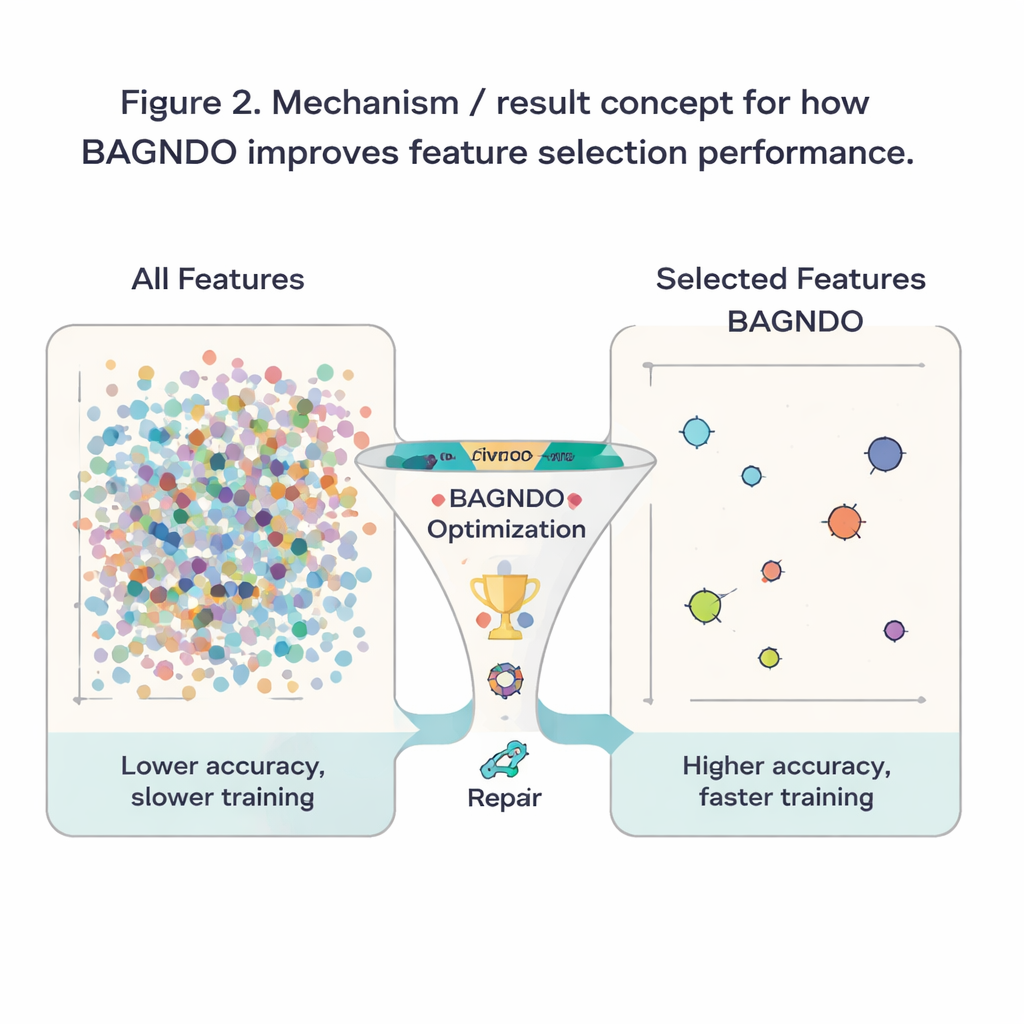

تخيّل تشخيص مرض مع مئات الاختبارات المعملية، والفحوصات، وإجابات الاستبيانات. قد تكون العديد من هذه «الميزات» ضوضائية أو مكرّرة أو غير ذات صلة، وإدخالها جميعاً في مُصنّف قد يضلّله بدلاً من مساعدته. يهدف اختيار الميزات إلى اختيار مجموعة أصغر وأكثر معلوماتية من المدخلات بحيث تصبح نماذج التعلّم الآلي أسرع وأرخص وأكثر موثوقية. يمكن للمرشّحات الإحصائية البسيطة إزالة الميزات غير المفيدة بوضوح، لكنها لا تخصّص اختياراتها للنموذج المستخدم غالباً وتفشل في اكتشاف التركيبات الدقيقة للمتغيرات. الطرق الأكثر تقدماً من فئة «اللفات» (wrapper) تقيم مجموعات الميزات باختبار مدى أداء المُصنّف مباشرةً، لكن هذا يخلق مشكلة بحث هائلة: عدد المجموعات الممكنة يتفجّر مع زيادة عدد الميزات.

البحث بذكاء بدلاً من العشوائية

لمواجهة هذا التفجير، يعتمد الباحثون على خوارزميات ميتاهيرستيك—استراتيجيات بحث مستوحاة من عمليات طبيعية أو فيزيائية توازن بين الاستكشاف الواسع والتنقيح المحلي المركّز. إحدى هذه الطرق، المحسّن بموزّع نورمالي معمّم (GNDO)، يتعامل مع الحلول المرشحة كما لو أنها مُقتطفة من منحنى جرس مرن ويحوّل هذا المنحنى تدريجياً نحو إجابات أفضل. نجح GNDO في تطبيقات هندسية وطاقة، لكنه يميل إلى الاستقرار مبكراً عند حلول متواضعة ويعاني لتحقيق توازن جيد بين الترحال العالمي والتعديل المحلي عند تطبيقه على اختيار الميزات. يحدد المؤلفون هذه النقطة كفجوة حرجة: المعادلات الأنيقة لـ GNDO لا تترجم تلقائياً إلى أداء قوي في قرارات نعم-أو-لا عالية البعد حول أي الميزات يجب الاحتفاظ بها.

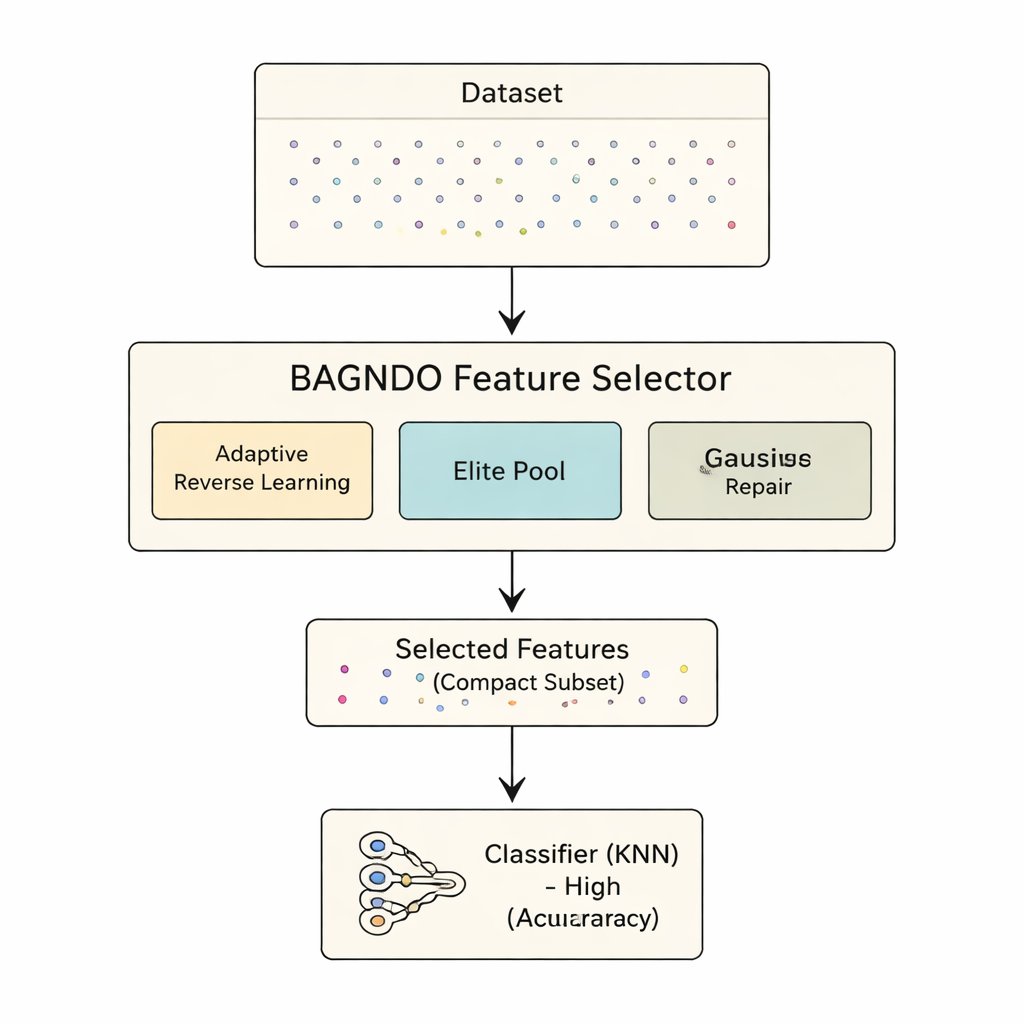

ترقية ثلاثية لآلية كلاسيكية

إطار العمل المقترح BAGNDO يطوّر GNDO بثلاث أفكار منسّقة. أولاً، استراتيجية التعلم العكسي الكوشي التكيّفية تُولّد بانتظام نسخ «مرآوية» من الحلول الحالية باستخدام توزيع احتمالي ذو ذيول ثقيلة. هذا يشجّع قفزات جريئة إلى مناطق غير مستكشفة من فضاء البحث، مانعاً الخوارزمية من الانحصار في أخاديد محلية. ثانياً، استراتيجية تجمع النخبة تحتفظ ليس بحل واحد أفضل فحسب، بل بمجموعة صغيرة من أفضل الحلول بالإضافة إلى مرشح «إرشادي» مدموج. تساعد هذه القيادة الأكثر ثراءً على الحفاظ على التنوع مع توجيه البحث نحو مناطق واعدة. ثالثاً، طريقة إصلاح أسوأ الحلول المستندة إلى التوزيع الغاوسي تنظر إلى أضعف المرشحين وتدفعهم نحو أنماط مستفادة من مجموعة النخبة، معيدة تدوير الحلول الضعيفة إلى حالات أفضل بدلاً من التخلص منها تماماً.

اختبار الطريقة عملياً

لاختبار فاعلية هذه الأفكار عملياً، طبّق المؤلفون BAGNDO على 18 مجموعة بيانات معيارية معروفة من مستودع UCI، تغطي التشخيص الطبي والألعاب والإشارات والمجالات الأخرى. في كل حالة، بحثت الخوارزمية عن مجموعة ميزات تسمح لمصنّف الجيران الأقرب التقليدي (k-NN) بإجراء تنبؤات دقيقة. واجهت BAGNDO تسعة منافسين أقوياء، بما في ذلك تحسين سرب الجسيمات وطرق شبيهة بالوراثة وعدّة خوارزميات مستوحاة من السرب الحديثة. عبر هذه الاختبارات، وجدت BAGNDO باستمرار مجموعات أصغر من الميزات مع الحفاظ غالباً على الدقّة أو حتى تحسينها. حققت أفضل دقّة مع أكثر مجموعات الميزات ضغطاً في 14 من أصل 18 مجموعة بيانات، وأكدت الاختبارات الإحصائية أن هذه المكاسب ليست نتيجة الصدفة.

ماذا يعني هذا لتعلّم الآلة اليومي

يمكن تلخيص النتيجة للمستخدم العادي ببساطة: بنى المؤلفون «مُختار ميزات» أكثر انضباطاً يساعد خوارزميات التعلّم على التركيز على ما يهم فعلاً في مجموعة البيانات. عن طريق موازنة أفضل بين الاستكشاف الواسع، وتوجيه النخبة، وإصلاح المرشحين الضعفاء، يزيل BAGNDO المدخلات غير الضرورية مع الحفاظ على الدقّة أو زيادتها. وهذا يعني نماذج أسرع، وتخفيض في تكاليف التخزين والحوسبة، وغالباً رؤى أوضح حول أي القياسات أو الأسئلة هي الأكثر معلوماتية. على الرغم من أن الطريقة أكثر تطلباً حسابياً من بعض البدائل الأبسط، إلا أنها تقدّم أداة قوية للمشكلات التي تكون فيها الدقّة والقابلية للتفسير أمرين أساسيين، من دعم القرار الطبي إلى مراقبة المصانع وما بعدها.

الاستشهاد: Ghetas, M., Elaziz, M.A. & Issa, M. Enhanced generalized normal distribution optimizer with Gaussian distribution repair method and cauchy reverse learning for features selection. Sci Rep 16, 4794 (2026). https://doi.org/10.1038/s41598-026-35804-y

الكلمات المفتاحية: اختيار الميزات, تحسين ميتاهيرستيك, التعلّم الآلي, خفض البُعد, دقّة التصنيف