Clear Sky Science · ar

دمج تجزئة المعاملات وخلط المجموعات للدفاع ضد الخادم غير الموثوق في التعلم الفيدرالي

لماذا حماية النماذج المشتركة مهمة

هواتفنا ومستشفياتنا وبنوكنا تعتمد بشكل متزايد على الذكاء الاصطناعي. في كثير من الأحيان، ترغب مؤسسات عديدة في تدريب نموذج مشترك معًا، لكن القوانين ومنطق السلوك السليم تمنعهم من تجميع بياناتهم الخام في مكان واحد. وُلد التعلم الفيدرالي لحل هذا التوتر: يدرب كل مشارك النموذج على جهازه ويشارك فقط تحديثات النموذج. لكن هذه الورقة تُظهر أن حتى تلك التحديثات يمكن أن تكشف معلومات خاصة إذا كان الخادم المركزي فضوليًا أو غير أمين—ثم تقدم طريقة جديدة لحماية بياناتنا وهوياتنا بشكل أفضل.

عندما لا يجب الوثوق بالخادم

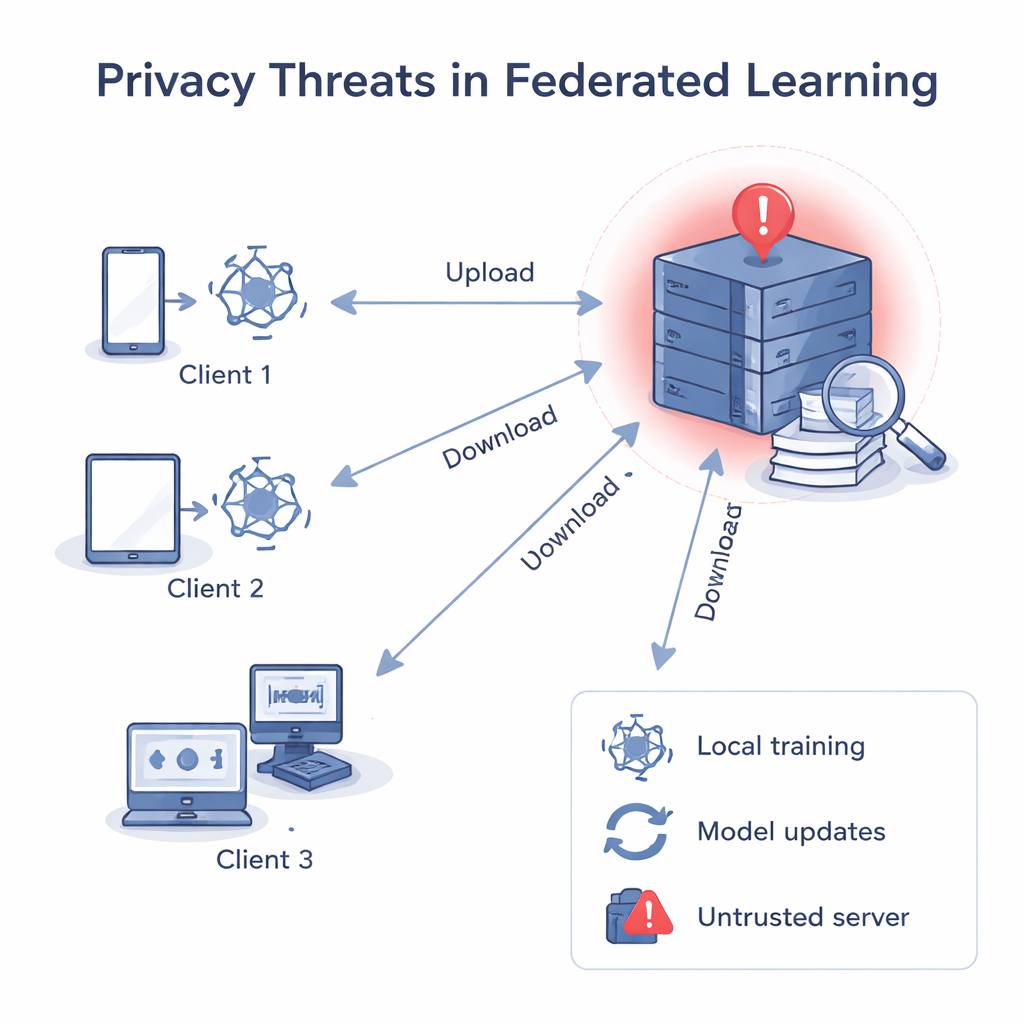

في التعلم الفيدرالي الكلاسيكي، يرسل خادم مركزي نموذجًا مشتركًا، يحسّنه كل عميل باستخدام بياناته المحلية، ثم يرسل النموذج المحدث مرة أخرى. يقوم الخادم بمتوسط هذه التحديثات للحصول على نموذج عالمي أفضل. على الرغم من أن البيانات الخام لا تخرج من الأجهزة، فقد أظهرت أبحاث سابقة أن التدرجات والأوزان—الأرقام داخل النموذج—يمكن «عكسها» لإعادة بناء بيانات خاصة، مثل صور أو نصوص، أو لاكتشاف ما إذا كانت سجلات معينة قد استُخدمت في التدريب. إذا كان الخادم المركزي غير موثوق، فيمكنه تحليل تحديث كل عميل بشكل منفصل، والتعرّف على بيانات ذلك العميل المحلية، وحتى ربط التحديث بشخص أو مؤسسة محددة.

تقسيم التحديثات إلى أجزاء غير ضارة

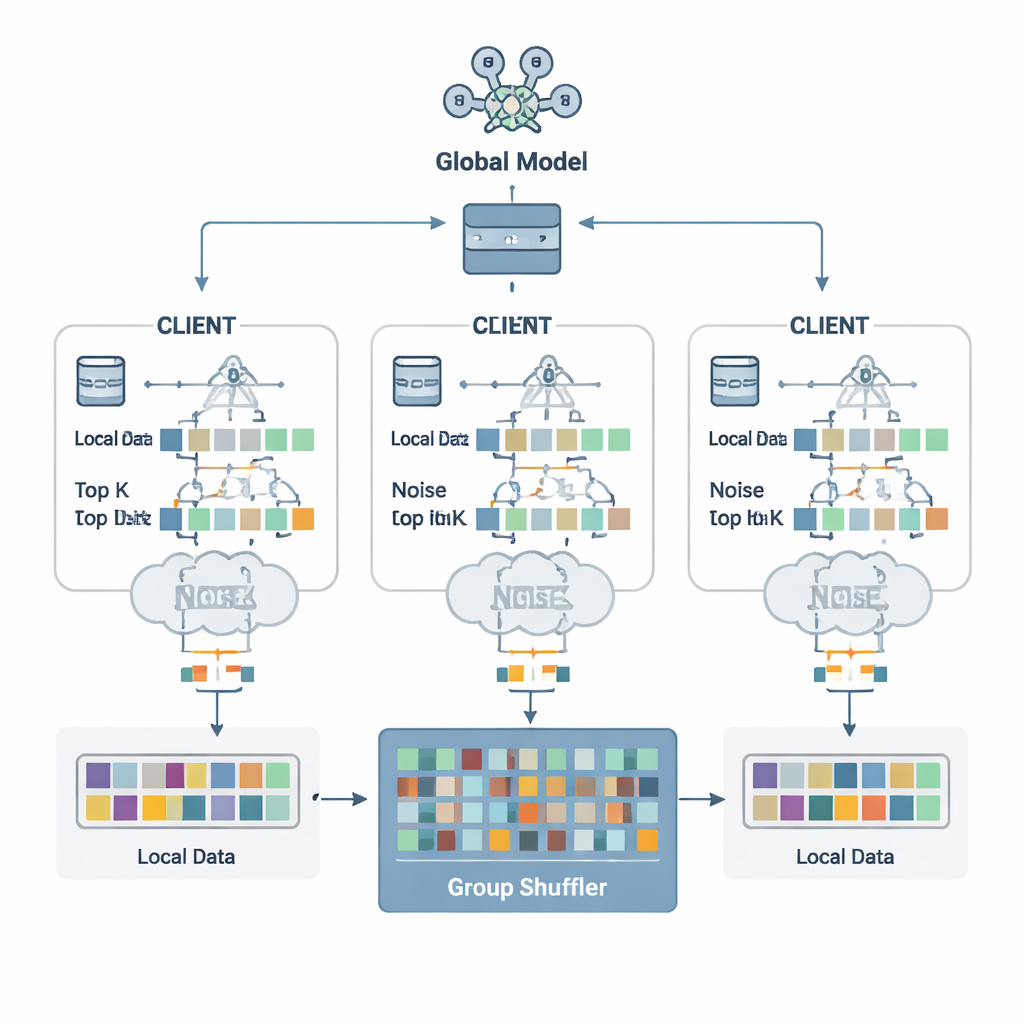

يقترح المؤلفون مخطط دفاعي يسمى الدفاع الأمني القائم على تجزئة المعاملات وخلط المجموعات (SDPFGS). فكرته الأولى بسيطة لكنها قوية: لا ترسل تحديثًا كاملاً أبدًا. بدلًا من ذلك، يقسم كل عميل تحديثه إلى عدة «شظايا» مصطنعة. معظم هذه الشظايا مملوءة بأرقام عشوائية، ويتم تعديل الشظية الأخيرة فقط بحيث تظل جميع الشظايا مجتمعة تساوي التحديث الحقيقي. أي شظية واحدة، أو حتى عدة شظايا، تبدو كضجيج ولا تكشف عن شيء تقريبًا من البيانات الأصلية. هذه الحيلة الرياضية تشبه تقنيات مشاركة الأسرار: لا يمكن استعادة الكل إلا بدمج كل الأجزاء.

إضافة الضجيج وتقليب المزيج

إرسال العديد من الشظايا قد يكون مضيعة، وإذا فُحصت معًا فقد تسمح لمهاجم باستنتاج المزيد. لتجنّب ذلك، يختار كل عميل فقط القيم الشظية الأكثر أهمية—أعلى K مدخلات التي تهم عملية التعلم—ويضيف إليها ضجيجًا عشوائيًا مُعايَرًا بعناية وفقًا لمبادئ الخصوصية التفاضلية. يجعل هذا الضجيج من الصعب إحصائيًا تحديد ما إذا كانت بيانات شخص معيّن قد أثّرت في قيمة معينة. ثم يأتي المكوّن الثاني الأساسي: خلط المجموعات. بدلًا من إرسال الشظايا مباشرة إلى الخادم، يمرر العملاء الشظايا إلى «مخلط» موثوق يخلط شظايا العديد من العملاء في مجموعات قبل إعادة توجيهها. بعد هذا الخلط، لم يعد الخادم قادرًا على معرفة أي شظية أتت من أي عميل، مما يقطع الرابط بين التحديثات والهويات.

الحفاظ على الدقة مع تقليل التسريبات

اختبر الفريق نظام SDPFGS على معايير قياسية للصور والنصوص، بما في ذلك أرقام اليد (MNIST)، وصور الملابس (Fashion-MNIST)، والصور الملونة (CIFAR-10 وCIFAR-100)، بالإضافة إلى مهمة تصنيف الأخبار. قارنوا طريقتهم بعدة تقنيات خصوصية متقدمة تستخدم الضجيج وحده، أو الخلط وحده، أو ضغط التدرجات البسيط. عبر هذه التجارب، حقق SDPFGS باستمرار دقة مساوية أو أعلى من الطرق المنافسة مع استخدام أقل للاتصالات ووقت تدريب أقل من كثير منها. والأهم من ذلك، في مواجهة هجمات قلب النموذج—حيث يحاول خصم إعادة بناء أمثلة التدريب—كان لـ SDPFGS أدنى معدل نجاح للهجوم، ما يعني أنه سرب أقل عن البيانات الأساسية.

ماذا يعني هذا للمستخدمين في حياتهم اليومية

لغير المتخصص، الرسالة الأساسية هي أن «إخفاء البيانات» وحده لا يكفي؛ يجب علينا أيضًا إخفاء ما ترسله أجهزتنا أثناء التدريب. يحقق SDPFGS ذلك بتحويل كل تحديث نموذج إلى شظايا مشوشة وممزوجة عديمة الفائدة بمفردها لكنها ما تزال تتجمع لتكوّن نموذجًا عالميًا عالي الجودة. النتيجة هي درع أقوى ضد خادم فضولي أو مخترق، مع تكلفة طفيفة فقط على الدقة والكفاءة. ومع انتشار التعلم الفيدرالي في الرعاية الصحية والتمويل والأجهزة الذكية، قد تساعد تقنيات مثل SDPFGS في ضمان أن يستفيد الناس من نماذج مشتركة قوية دون تسليم مفاتيح حياتهم الخاصة.

الاستشهاد: Guo, H., Chen, W., Li, J. et al. Combining parameter fragmentation and group shuffling to defend against the untrustworthy server in federated learning. Sci Rep 16, 5097 (2026). https://doi.org/10.1038/s41598-026-35420-w

الكلمات المفتاحية: التعلم الفيدرالي, خصوصية البيانات, الخصوصية التفاضلية, هجمات قلب النموذج, التجميع الآمن