Clear Sky Science · ar

فحص اعتماد البشر على الذكاء الاصطناعي في صنع القرار

لماذا تهم ثقتنا في الآلات الذكية

من توصيات الأفلام إلى فحص المرشحين للوظائف والعدل الجنائي، يساعد الذكاء الاصطناعي (AI) بشكل متزايد الناس على اتخاذ قرارات. يفترض كثيرون أن الحواسيب أقل تحيزًا وأكثر دقة من البشر. لكن ماذا يحدث فعلاً عندما يتلقى الناس نصيحة من نظام ذكاء اصطناعي — هل يستخدمونها بحكمة أم يعتمدون عليها بشكل مفرط؟ تستكشف هذه الدراسة كيف يستجيب الناس لإرشادات AI مقارنة بإرشادات بشرية، وما يعنيه ذلك لدور الذكاء الاصطناعي المتنامي في قرارات الحياة اليومية.

اختبار أشخاص حقيقيين بوجوه حقيقية ومزيفة

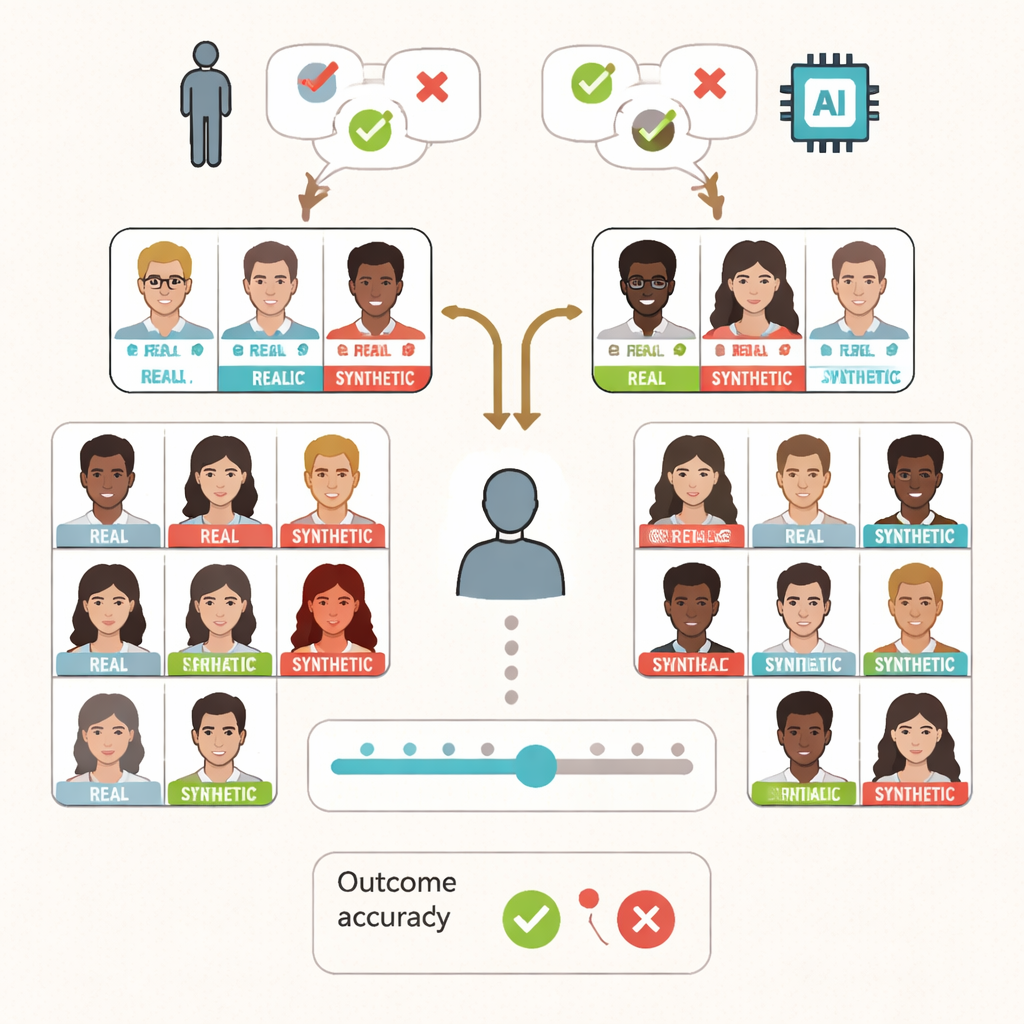

طلب الباحثون من 295 بالغًا أداء مهمة تبدو بسيطة: تحديد ما إذا كانت الصورة المعروضة لوجه على الشاشة هي تصوير لشخص حقيقي أم وجه مولّد بالذكاء الاصطناعي. رأى كل مشارك 80 وجهًا — نصفها حقيقي ونصفها مُركّب — تم اختيارها بعناية من أعمال سابقة بحيث يتمكن معظم الناس من تمييزها إلى حد كبير، لكن ليس بدقة كاملة. إلى جانب كل وجه، ظهر للمشاركين مقترح قصير يقول ما إذا كان الوجه "حقيقيًا" أم "مصطنعًا". أُبلغ المشاركون أن هذه النصائح جاءت إما من مجموعة خبراء بشريين أو من نظام ذكاء اصطناعي، رغم أن كل الإرشادات كانت مبرمجة مسبقًا وكانت صحيحة في الواقع في نصف الحالات فقط.

استخدام النصيحة، لكن ليس بشكل أعمى

السؤال المركزي كان ما إذا كان الناس سيتبعون النصيحة ببساطة أم سيُفكرون بأنفسهم. تُظهر النتائج أن المشاركين لم يتصرفوا كآلات تضغط على أزرار فقط. اتبعوا النصيحة بدرجة أكبر عندما كانت صحيحة، وكانوا أكثر احتمالًا لتجاهلها عندما كانت خاطئة، سواء كان مصدرها يُزعم أنه بشري أو AI. ظلت الدقة العامة في تمييز الوجوه الحقيقية عن الصناعية تقريبًا عند ثلثي الحالات — شبيهة جدًا بمجموعة منفصلة من بحث سابق أدت نفس المهمة دون أي إرشاد. بعبارة أخرى، وجود "مساعد" AI لم يحسّن الأداء بشكل دراماتيكي ولا أفسده في المتوسط.

متى تؤدي المواقف الإيجابية تجاه AI إلى نتائج عكسية

تحت هذه المتوسطات، برز نمط أدق. أكمل المشاركون أيضًا استبيانات حول مدى ثقتهم بالآخرين عموماً وبمشاعرهم تجاه AI. الذين أبدوا مواقف أكثر إيجابية تجاه الذكاء الاصطناعي أصبح أداؤهم في التمييز بين الحقيقي والمزيف أسوأ عندما تلقوا إرشادًا من AI. كانوا أقل قدرة على التفريق بين الوجوه الحقيقية والمصطنعة مقارنة بالمشاركين الذين امتلكوا آراء أكثر حذرًا أو سلبية تجاه AI. لم يظهر هذا التأثير عندما اعتقد الناس أن الإرشاد جاء من بشر، ما يشير إلى أن نصيحة AI قد تشكل أحيانًا طريقة مميزة في التأثير على صنع قرارنا وتشويهه. كما وجدت الدراسة أن الأشخاص الذين ادّعوا أنهم يعتمدون دائمًا على الإرشاد أدّوا أسوأ من أولئك الذين قالوا إنهم يستخدمونه أحيانًا أو لا يستخدمونه على الإطلاق.

لا يزال الناس هم الحاسمون في القرار

بحث الباحثون أعمق في كيفية موازنة الناس بين حكمهم الخاص والإرشاد. في المتوسط، أظهر المشاركون انحيازًا نحو وسم الوجوه بأنها حقيقية، ونمت هذه النزعة قليلًا بين أولئك الذين أبلغوا عن ميل أكبر لثقة الآخرين. ومع ذلك بدا استخدام الناس للإرشاد "استراتيجيًا": إذ لجأوا إليه خصوصًا عندما كانوا أقل يقينًا. وتطابقت تقييمات الثقة مع الأداء بدرجة معقولة — عندما شعر الناس بثقة أكبر، كانوا عمومًا أكثر دقة — مما يشير إلى أن المشاركين كان لديهم إحساس معقول بمواضع صحة أو خطأ قرارهم، حتى مع وجود AI في الحلقة.

ما الذي يعنيه هذا لأدوات AI اليومية

بالنسبة للقارئ العام، الرسالة الأساسية هي أن AI لا يزيل الانحياز البشري سحريًا، ولا يغلب حكمنا تلقائيًا. غالبًا ما يتعامل الناس مع نصيحة AI بطريقة تشبه نصيحة البشر ويمكنهم تجاهلها عندما تبدو غير مفيدة. لكن عندما يكون لدى شخص ما تصوّر شديد الإيجابية تجاه AI، فقد يميل إلى الاعتماد عليه بطرق تقلل من دقته. ومع انتشار أنظمة AI في مجالات حساسة مثل الرعاية الصحية والأمن والعدالة، سيحتاج المصممون وصانعو السياسات إلى فهم هذه الميول البشرية. تشير هذه الدراسة إلى أن الاستخدام الفعّال للذكاء الاصطناعي لا يعتمد فقط على خوارزميات أفضل، بل على أفراد مطّلعين يعرفون متى يثقون بالآلة — ومتى يثقون بأنفسهم.

الاستشهاد: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

الكلمات المفتاحية: الذكاء الاصطناعي, صنع القرار البشري, الثقة في الذكاء الاصطناعي, انحياز الأتمتة, وجوه مزيفة عميقة