Clear Sky Science · ar

الذاكرة الفسيفسائية لنماذج اللغة الكبيرة

لماذا تهم النسخ شبه المتطابقة

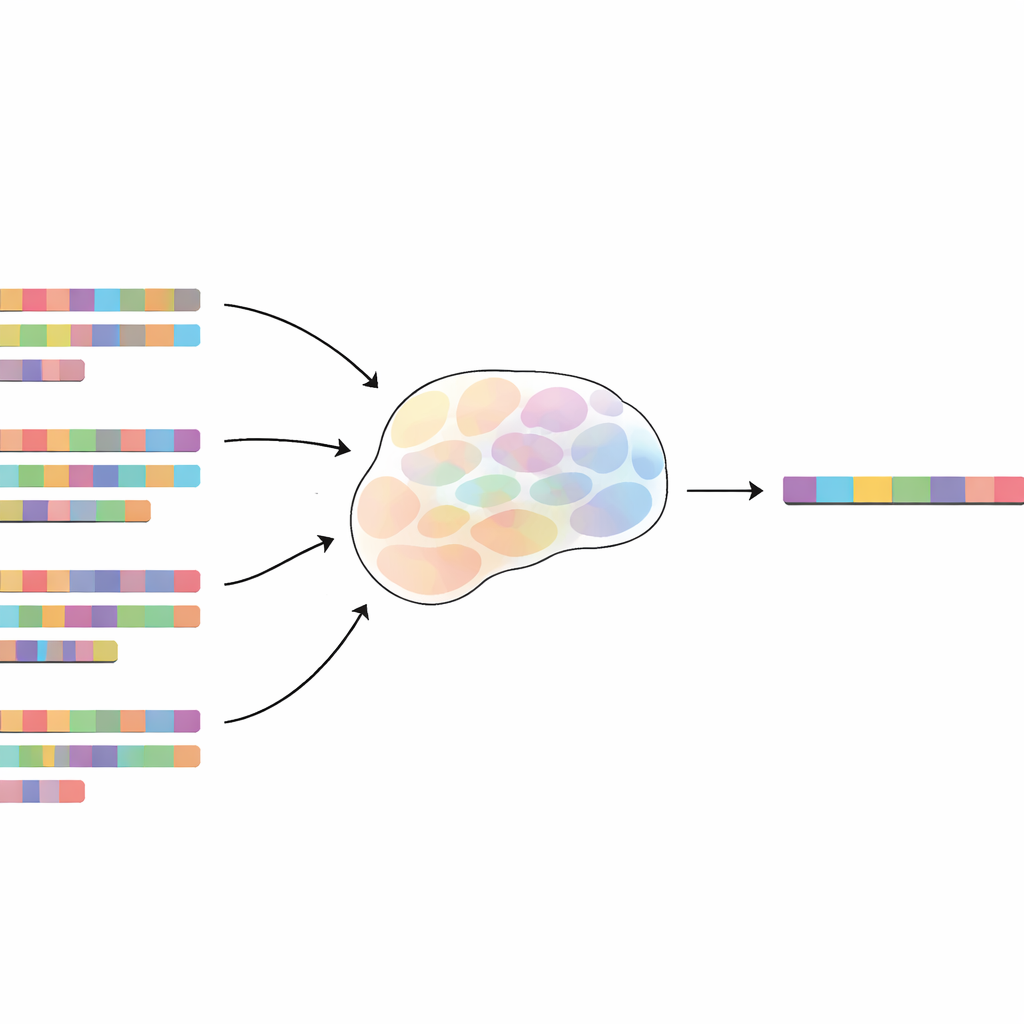

تتعلم نماذج اللغة الكبيرة مثل ChatGPT من محيطٍ من النصوص، وأحيانًا تحفظ أجزاءً من هذا النص حرفيًا. يثير ذلك مخاوف تتعلق بالخصوصية وحقوق النشر وكيفية تقييم ما تعرفه هذه الأنظمة بشكل عادل. تُظهر هذه الورقة أن الحفظ ليس مقتصرًا على النسخ واللصق الدقيق فقط. بدلاً من ذلك، يمكن لنماذج اللغة إعادة بناء مقاطع من العديد من النسخ التي تختلف قليلاً، تمامًا كما يجمع المرء قطعة فسيفساء. فهم هذا النوع المخفي من الذاكرة ضروري لأي شخص يهتم بذكاء اصطناعي آمن وموثوق.

طريقة جديدة للتفكير في ذاكرة الآلة

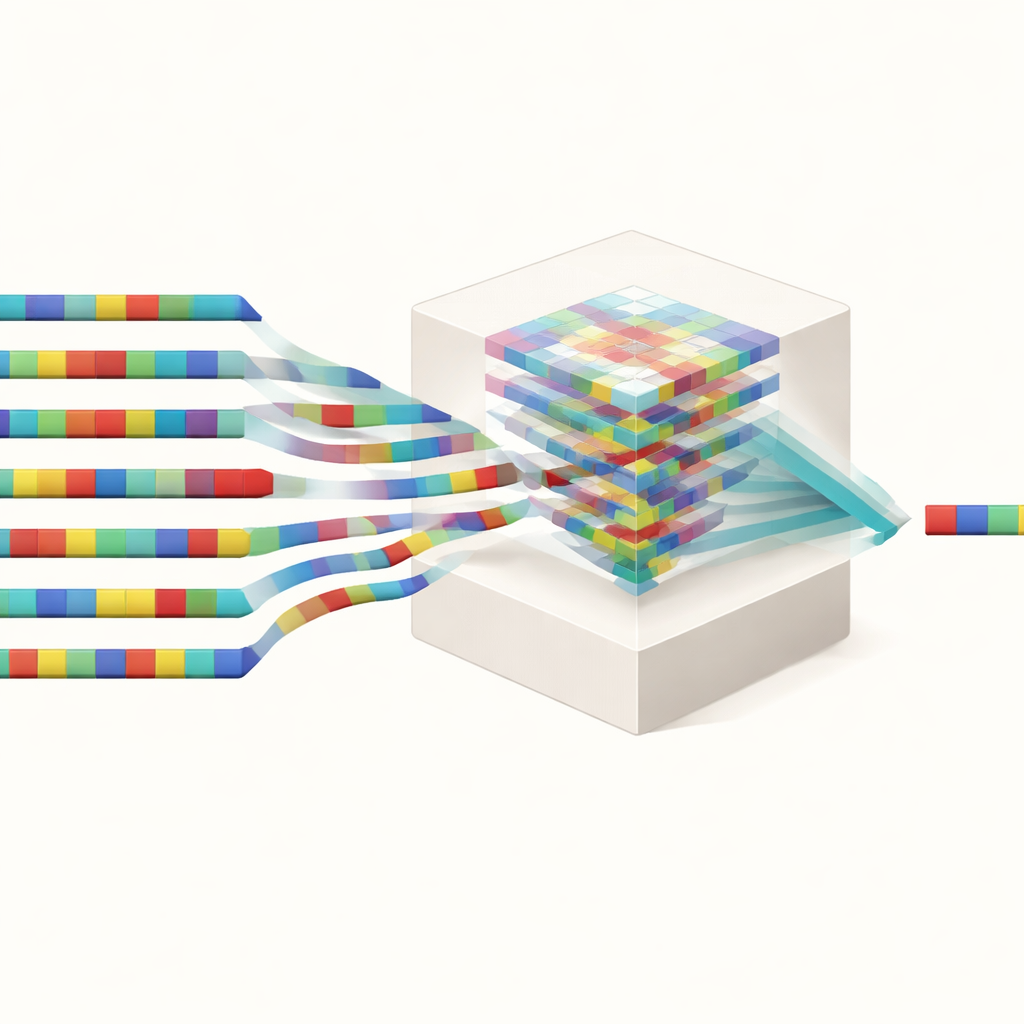

يفترض معظم الناس أن نموذج اللغة لا يحفظ شيئًا إلا إذا رأى نفس الجملة بالضبط مرارًا وتكرارًا. يتحدى المؤلفون هذا التصور من خلال تقديم مفهوم «الذاكرة الفسيفسائية». وفق هذا المفهوم، يمكن للنموذج أن يحفظ مقطعًا مكوّنًا من 100 كلمة ليس فقط من التكرارات الدقيقة، بل أيضًا من العديد من النسخ الشبه المطابقة—نسخ تُحذف أو تُغيّر أو تُعيد ترتيب بعض كلماتها. لدراسة هذا بعناية، يغرسون عبارات اختبار اصطناعية تُسمّى كاناريز في بيانات التدريب، مع العديد من النسخ المعدّلة لها. بعد التدريب، يقيسون مدى سهولة تحديد ما إذا كانت كاناري معيّنة وُضعت في مجموعة التدريب باستخدام نوع من اختبارات الخصوصية يُعرف بهجوم استدلال العضوية (membership inference attack).

كيف تترك النسخ الضبابية أثرًا واضحًا

بمقارنة النسخ الشبه المطابقة بالتكرارات الدقيقة، يعرّف الباحثون «ما يعادل النسخة الدقيقة»: مقدار مساهمة نسخة شبه مطابقة في الحفظ مقارنةً بنسخة كاملة دقيقة. يجدون أن حتى التغييرات الطفيفة تكاد لا تُضعف التذكر. إذا استُبدلت نحو 10% من كلمات كل نسخة عشوائيًا، فإن النسخة الشبه مطابقة الواحدة لا تزال تساهم بحوالي 60–65% من مساهمة النسخة الدقيقة. وحتى عندما يُغيَّر نصف الكلمات، تظل كل نسخة معدّلة تمثل نحو 15–20% من نسخة كاملة. التأثير ثابت: إضافة كلمات حشو عشوائية بين العبارات الأساسية أو خلط مقاطع الجملة يقلل من الحفظ لكنه لا يلغيه. يبدو أن النموذج قادر على تجاوز الضوضاء والتركيز على المقاطع المتداخلة وتجميعها مرة أخرى.

الشكل على المعنى فيما تخزنه النماذج

نظرًا لأن نماذج اللغة الحديثة قادرة على حل مسائل رياضية واتباع التعليمات وترجمة بين لغات، قد يتوقع المرء أن تكون ذاكرتها متعلقة بالمعنى. بشكل مفاجئ، تجد الدراسة العكس. عندما يستبدل المؤلفون كلمات ببدائل تحافظ على معنى الجملة، يتحسن التذكر بشكل طفيف فقط مقارنةً باستبدالها بكلمات عشوائية. تُسهم إعادة الصياغة التي تُنتجها أنظمة ذكاء اصطناعي أخرى—والتي تحافظ على الفكرة نفسها مع تغيير العديد من التفاصيل السطحية—قليلاً في الحفظ ما لم تتشارك بعدد كبير من تسلسلات الكلمات القصيرة مع المقطع الأصلي. عبر سلسلة من الاختبارات، ما يدفع الذاكرة حقًا هو التداخل في الرموز الدقيقة (وحدات الكلمات الأساسية لدى النموذج)، لا الأفكار المشتركة. بعبارة أخرى، الذاكرة الفسيفسائية للنموذج ترتبط بالشكل أكثر مما ترتبط بالمعنى.

النسخ المخبأة في بيانات التدريب الحقيقية

ثم يسأل المؤلفون إلى أي مدى تنتشر النسخ الشبه المطابقة في مجموعة بيانات ويب شعبية ومُنظَّفة كثيرًا تُستخدم لتدريب نماذج اللغة تُعرف باسم SlimPajama. رغم أن هذه المجموعة قد أزالت بالفعل الوثائق المتطابقة تقريبًا، يجد الفريق أن العديد من تسلسلات المئة رمز التي تظهر بالضبط 1000 مرة لديها أيضًا آلاف النسخ الشبه المطابقة. بالنسبة لمسافات تحرير صغيرة—ما يقرب من 10% من الأحرف مُغيرة—هناك في المتوسط حوالي 4 أضعاف النسخ الشبه المطابقة مقارنةً بالنسخ الدقيقة، وعشرات الآلاف أكثر عند مسافات أكبر لكنها لا تزال ذات تأثير. والأهم أن تقنيات «إزالة التكرار» القياسية المستخدمة في الصناعة، والتي تزيل عادةً التداخلات الدقيقة الطويلة فقط، تترك معظم هذه النسخ الشبه المطابقة دون تغيير. هذا يعني أن النماذج لا تزال قادرة على حفظ مواد حساسة أو محمية بحقوق الطبع والنشر عن طريق تجميعها من مصادر عديدة مُعدّلة قليلًا.

لماذا يهم هذا الخصوصية والعدالة والضبط

للاكتشافات هذه تبعات واسعة النطاق. بالنسبة للخصوصية، تُظهر أن إزالة التكرارات الدقيقة من بيانات التدريب وحدها غير كافية: يمكن أن تُحفظ معلومات شخصية أو سرية عبر عائلات من المقاطع المماثلة. بالنسبة لحقوق النشر وقياس الأداء، يمكن للنسخ الشبه المطابقة أن تجعل النماذج تعيد إنتاج نصًا محميًا أو تُحسّن درجاتها في اختبارات رأت أشكالًا مُموّهة منها فعليًا. في جهود «نسيان» بيانات محددة، لا يكفي حذف مثالٍ مسيء واحد إذا بقيت العديد من المتغيرات. بشكل عام، تكشف الدراسة أن ذاكرة نماذج اللغة مركّبة على شكل فسيفساء مبنية من تداخلات صغيرة عديدة، مما يتحدى أدوات السلامة الحالية ويدعو إلى طرق أنحف وأكثر دقة لتنظيف وتدقيق بيانات التدريب.

الاستشهاد: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

الكلمات المفتاحية: تذكر نموذج اللغة, النسخ الشبه المطابقة, خصوصية البيانات, إزالة التكرار من بيانات التدريب, تلوث مجموعات الاختبار